Cum funcționează?

Introducere

Acest capitol conține evoluția sistemelor de recomandare, obiectivele măsurabile AI și arhitectura soluțiilor de top. Apoi compară abordarea Build (dezvoltare custom) cu cea Managed (soluție nativă cloud) și prezintă diagrama unei implementări hibride "privacy-first" din proiectele noastre. La final discutăm provocările implementării AI pentru recomandări.

Vânzările B2B trebuie să respecte simultan relevanța, marja și disponibilitatea, ceea ce duce la două provocări specifice. Cum se impun regulile stricte comerciale (en. guardrails) și cum se definește contractul de date care garantează calitatea recomandărilor.

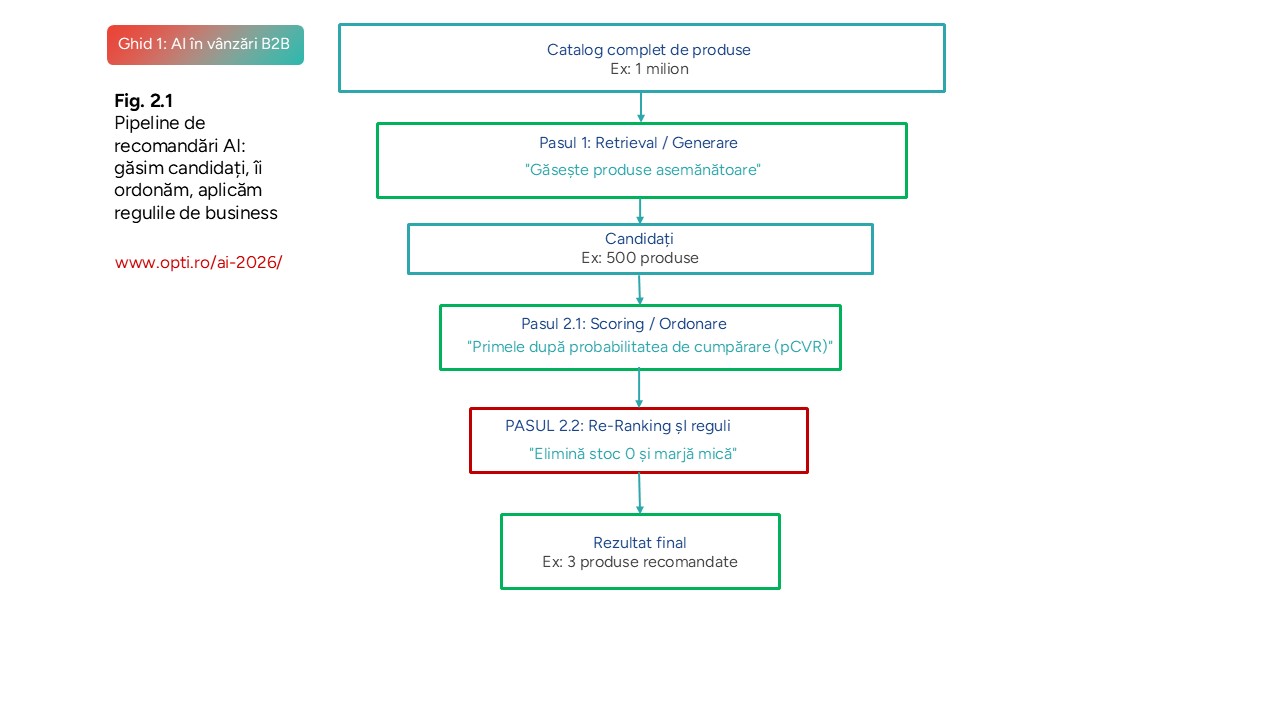

Ca introducere tehnologică, aceasta este diagrama arhitecturii funnel (pâlnie) pentru un sistem de recomandări:

CATALOG COMPLET DE PRODUSE (ex: 1 milion)

│

▼

PASUL 1: RETRIEVAL/GENERARE (Viteză mare, acoperire largă)

"Găsește 500 de produse asemănătoare"

(Căutare vectorială + filtre lexicale)

│

▼

CANDIDAȚI (ex: 500 produse)

│

▼

PASUL 2.1: SCORING / ORDONARE (Viteză medie)

"Primele după probabilitatea de cumpărare (pCVR)"

(Rețea neuronală Deep Learning)

│

▼

PASUL 2.2: RE-RANKING ȘI REGULI (Rapid)

"Elimină stoc 0 și marjă mică"

(Post-procesare prin guardrails)

│

▼

REZULTAT FINAL (ex: 3 produse recomandate)

Pentru cursivitatea lecturii, vom ilustra conceptele tehnice cu ecosistemul Google Cloud. Dar arhitectura prezentată este universală: ea poate fi replicată în alte cloud-uri, ca Microsoft Azure sau Amazon Web Services sau cu diferite soluții SaaS.

| Produse | |

|---|---|

| Google Cloud | Platformă de cloud Google. |

| Vertex AI | Platformă de tehnologii AI, open-source sau proprietare în interiorul Google Cloud. |

| Vertex AI Search | Tehnologie gestionată de Google pentru căutare cu AI și aplicații pe baza căutării, inclusiv în fișiere. Vezi Ghidul #4 |

| Vertex AI Search for commerce (fost Retail) | Tehnologie gestionată de Google pentru RecSys (sistem de recomandări) sau căutare de produs, corespunde cu varianta Managed din capitol. |

| Modele AI | |

| Model fundațional | Foundation Model. Model LLM generativ (ex: Google Gemini). |

| Model antrenat (tuned) |

Model fundațional antrenat de companie (ex: prin Tuning API în Vertex AI).

|

| Model pre-antrenat | Model AI predictiv (Deep Learning, Gen 3) antrenat pe tranzacții globale anterioare (ex: Google Shopping). Sinonim în general în text cu sistemul de recomandări. |

Notă: Denumirile și funcționalitățile produselor se pot modifica. Vezi Glosarul complet aici

Ghid: Cum alegi un partener Google Cloud de implementare

De la cunoaștere organizațională la Deep Learning

Istoricul generațiilor de recomandări explică cum am ajuns în momentul prezent. Vom vedea o evoluție de la intuiție umană la inginerie matematică, care devine accesibilă la scară largă prin AI.

Gen 0: Cunoașterea organizațională ne-automatizată

În multe echipe de vânzări, recomandările se bazează pe expertiza agenților seniori și know-how-ul companiei. Compania știe că "X preferă marca Y" sau că "Acestui tip de pompă i se potrivește doar acest racord".

Limitarea majoră este scalabilitatea și riscul de personal. După un nivel, compania:

- Crește know-how-ul propriu doar prin programe riguroase de training

- Poate aplica politica comercială doar cu documentație internă detaliată și proceduri stricte

Când un agent senior părăsește compania, se pierd conexiunile logice. Agenții noi vând produse de bază, ratând oportunitățile de upsell timp de 6-12 luni (en. ramp-up). De altfel, indicatorii citați în Cap. 1 arată impact maxim al AI în cazul agenților de vânzări juniori.

Acest tip de cunoaștere este esențială pentru configurarea personalizată a AI, pentru că exprimă direct specificul de succes al companiei. AI nu înlocuiește intuiția agenților seniori, ci o scalează.

Gen 1: Sistemele expert și regulile statice (anii 2000-2015)

Odată cu apariția e-commerce și a platformelor ERP, companiile au început să instituționalizeze know-how-ul și regulile proprii.

Tehnologie

Sistemele expert sunt colecții de condiții IF-THEN (dacă-atunci) organizate logic. Funcționarea depinde de customizări. Ex: în multe sisteme ERP un Product Manager setează manual compatibilitățile per categorii sau per produse: "Dacă produsul este Laptop Lenovo T480, afișează la accesorii: Docking Station Lenovo". În distribuție, caracteristicile de corelat sunt de regulă prea multe pentru gestiune manuală.

Limitarea majoră este mentenanța:

- Într-un catalog cu 50.000 de repere, este imposibil să menții manual legăturile.

- Companiile de succes definesc riguros taxonomia ierarhică care le permite o gestiune eficientă per categorii.

- Regulile se pot perima: accesoriile nu mai sunt în stoc sau ies din oferta producătorului.

O altă limitare este rigiditatea. Sistemul nu ține cont de clientul concret, ceea ce forțează companiile B2B să opereze o ierarhie de aprobare manuală a discounturilor sau un sistem de fidelizare.

Logica de Gen 1 rămâne esențială în pregătirea datelor pentru machine learning și pentru ordonarea și filtrarea recomandărilor AI, obținând control.

Gen 2: Filtrare colaborativă (anii 2015 - 2020)

Bine cunoscută pentru zonele "Cine a cumpărat asta, a mai cumpărat și...", tehnologia clasică Amazon-style, folosită de giganții mondiali și locali de e-commerce. De aceea, multe pluginuri populare (ex: Woocommerce) încă vând ca AI această logică.

Tehnologie

Se bazează pe lucru cu matrici matematice (Matrix Factorization) și algoritmi k-NN (k-Nearest Neighbors). Se analizează matricea încrucișată de tranzacții istorice. Algoritmii găsesc tipare încrucișate în istoricul de cumpărări doar între ID-urile produselor comandate împreună.

Limitarea majoră este problema lipsei de istoric (Cold Start), în special în B2B:

- Algoritmul analizează doar produsele deja cumpărate și doar ID-urile lor.

- Produsele noi (ex: produsele din cataloagele furnizorilor care încă nu s-au impus în piață) și clienții noi nu primesc recomandări relevante.

- Companiile se vor baza tot pe cunoaștere organizațională (Gen 0): agenții seniori știu din experiența cu alte produse similare și cu alți clienți similari care este abordarea de vânzare recomandată.

O altă limitare este biasul de popularitate. Algoritmii de Gen 2 tind să recomande doar best-sellers, fără produsele de nișă care deseori au marjă mai mare (en. long tail).

Gen 3: Recomandări prin Deep Learning contextual

Standardul de astăzi în AI predictiv (en. Predictive AI) a fost accelerat de marile platforme ca YouTube, Google Shopping, Netflix. Este folosit în ultimii ani de marii jucători, inclusiv din România, iar progresul AI le democratizează pentru segmentul mid-market, vezi abordarea Managed în Cap. 2.4.

Pe aceeași tehnică se bazează căutarea hibridă, care combină căutarea lexicală (ex. SKU, dimensiuni apropiate) cu cea semantică (ex: holșurub = șurub autofiletant). Ea aduce cele mai mari beneficii în software-uri B2B, vezi aplicații în Ghid #4.

Tehnologie

Deep Learning înseamnă rețele neuronale aplicate (aproape) real-time. Se folosesc DCN (Deep & Cross Network - promovat de Google) și arhitecturi Transformer pentru recomandări secvențiale (pe clickuri, nu pe cuvinte ca în ChatGPT).

Ce face în plus Gen 3:

1. Înțelege secvența de vânzare

Sistemul înțelege ciclicitatea consumabilelor. Dacă o clinică a cumpărat un ecograf azi, nu va cumpăra altul mâine. Dar va avea nevoie de obicei de gel conductiv. Algoritmul prezice probabilitatea de cumpărare și se poate genera un widget "Cumpără-l din nou".

Cu un model AI de prognoză temporală (en. time-series modeling) adăugat, poate prezice și data epuizării stocului clientului, activând livrabilul Predicție de re-aprovizionare din Cap. 3.

Scenariu de abordare hibridă:

- Middleware-ul unui distribuitor cu 200.000 de produse interoghează un model de predicție temporală (ex: Vertex AI Forecast) și calculează "Produsul X se va epuiza în 8 zile".

- Rezultatul este scris în baza de date ca atribut "Dată estimată epuizare stoc".

- Atributul este trimis în Vertex AI Search for commerce unde un control îl promovează (Boost) sau retrogradează (Bury) la vânzare, în funcție de strategie.

- Middleware-ul pornește un flux automatizat de comandă furnizor.

2. Înțelege conținut (en. Content-Based) inclusiv multimodal

Când apare un produs nou fără istoric, AI predictiv analizează atributele (complete și descriptive). Îl "înțelege" și îl recomandă clienților relevanți, rezolvând problema lipsei de istoric (Cold Start) din Gen 2.

Vezi extracția de atribute din imagini și PDF-uri în Ghidul #3: Input Multimodal

3. Prelucrează contextul

Ia în calcul nu doar cine ești, ci și ce faci acum. De exemplu: clientul este pe mobil, este grăbit, este în timpul programului de lucru sau în weekend.

Sistemele de recomandări bazate pe Deep Learning pot vinde un produs nou unui client nou, în timp ce Gen 2 vinde ce este deja popular.

Modelele pre-antrenate din produse ca Vertex AI Search for commerce sunt excelente pentru clienți anonimi sau noi, chiar fără personalizare, în urma experienței pe sisteme ca Google Shopping.

Putem avea aplicații generative ca chatbots adăugate peste baza predictivă. Aceștia sunt disponibili și în varianta Build ( custom) și în varianta Managed. Precizăm că nu o să antrenăm în B2B un LLM de la zero (din motive de cost), dar se pot integra inclusiv variante open-source.

Gen 4: Agenți AI

Deja în 2026, agenții AI bazați pe LLM-uri sunt peste tot în presă, de exemplu după lansarea UCP pentru negociere automată între agenți. Modelele LLM sunt excelente ca interfață conversațională și ca orchestrator: pot explica recomandările făcute, rezuma contextul comercial și pot propune rapid reguli de business, deși nu le pot aplica în condiții de siguranță (în urma riscului de halucinații) și rapid.

Pentru un sistem de recomandări scalabil, cu latență strictă și cost predictibil, sistemul rămâne de regulă Gen 3. Aplicațiile LLM intervin punctual, de exemplu prin chatbots care explică și justifică recomandările. Vezi livrabilul Copilot în Cap. 3.3.1.

Tehnologie

LLM-urile sunt tot forme de Deep Learning dar antrenate generativ pe o cantitate uriașă de date (aproape toată cunoașterea scrisă). Impactul mondial al ChatGPT și al agenților AI justifică numele de Gen 4. Există variante de implementare unde timpul de generare scade sub 0,5 sec (ex: Small Language Models)

| Generație | Baza deciziei | Avantaje | Riscuri |

|---|---|---|---|

| Gen 0 | Memorie | Context excelent | Pierdere know-how odată cu personalul. Training dificil. |

| Gen 1 | Reguli statice | Control total | Mentenanță imposibilă la volum crescut. |

| Gen 2 | Statistică | Automatizare | Cold Start: Nu recomandă produse noi sau clienților noi. |

| Gen 3 (predictiv) | Deep Learning |

Predicție intenție.

Căutare semantică.

Chatbots (se adaugă LLM).

|

Necesită modele pre-antrenate (ex: Google) sau tuning pe date suficiente. |

| Gen 4 (agentic) | Deep Learning generativ |

Raționează, realizează acțiuni.

|

Nu este prima alegere ca sistem de recomandări scalabil și stabil. |

Context vs. prompt și combinația predictiv - generativ

În AI predictiv (Gen 3) modelele operează pe context structurat: produse, evenimente, clienți, reguli. Context engineering (alegerea și curățarea atributelor, definirea evenimentelor corecte, guardrails) are un impact major asupra calității rezultatelor.

Promptul ca instrument de control al tonului apare doar în aplicații construite deasupra fundației predictive cu adăugarea unei funcții generative (Gen 4), de exemplu în Vertex AI Search for commerce poți crea chatboți care separă intenția de căutare de cea de cumpărare, prin conectarea în noul mod Conversational (vezi Ghidul #4). Agentul conversațional va rula peste baza predictivă care a asociat produsele.

Pe scurt:

- Gen 0-1 oferă context și control.

- Gen 2-3 oferă scalare și personalizare și astăzi permite chatbots.

- Gen 4 oferă inteligență aplicată, dar este încă înceată pentru recomandări și upsell.

- Arhitectura hibridă le combină, nu le înlocuiește.

Pentru orizontul 2027, vezi Noutăți AI - Tehnologii care evoluează.

Cum măsurăm succesul AI?

Puteți organiza motorul de vânzări cu AI în jurul unor noțiuni fundamentale, care se pot transforma în indicatori măsurabili ai companiei. Vezi și livrabilele din Cap. 3 .

Scopuri de business

1. Optimizarea experienței clientului

Motorul performanței de vânzări. AI este folosit să lege datele companiei de experiența clientului (frontend prin e-commerce, dar și în vânzări directe sau multi-channel) prin personalizare și inteligență contextuală.

"Adopting gen AI into external-facing use cases is the difference between providing a personalized, accurate response versus a generic one. "

2. Automatizarea proceselor interne

Utilizarea AI pentru a ajuta agentul intern să vândă (pe post de copilot), scopul fiind ca oamenii să se poată concentra pe activități cu valoare înaltă, fără sarcini repetitive.

"Automating repetitive tasks [...] frees up human capital for higher-value activities."

Bază tehnologică

3. Modele și tuning (personalizare)

Adaptarea AI la specificul datelor, produselor și clienților companiei aduce alfabetizarea digitală a companiei și adoptarea tehnologiilor de top. Se pot folosi modele pre-antrenate sau să personalizați (tune) modelele fundaționale (ex: Google Gemini)

"Customers can customize foundation models for specific use cases by tuning them using our

tuning

APIs."

Sursa: Google Cloud - Delivering trusted and secure AI Whitepaper 2025

4. Curățenia și relevanța datelor

Recomandările bazate pe contextul exact al clientului depind de date de calitate, din toate sistemele companiei. Curățarea și controlul asupra datelor proprii sunt cheia succesului.

"Deliver more data relevance [...] directly relevant to the specific context."

Sursa: Google Cloud - Delivering trusted and secure AI Whitepaper 2025

5. Guardrails (reguli de siguranță)

Reguli care protejează compania și imaginea sa, evită recomandările absurde, pierderile (ex: vânzarea sub marjă). Pot fi deterministice ca sistemele expert, conform ideii de arhitectură hibridă. Google Cloud include și controale de siguranță în produsele sale AI.

"Customizable technical controls such as safety filters [...] configured based on both probability and severity scores."

Sursa: Google Cloud - Delivering trusted and secure AI Whitepaper 2025

Reglaje de finețe

6. AI explicabil (xAI)

Capacitatea de a explica de ce s-a făcut o recomandare, pentru a câștiga încrederea agentului, a managementului și în final a clientului.

"Explainable AI tools [...] help understand and interpret predictions made by machine learning models."

Sursa: Google Cloud - Delivering trusted and secure AI Whitepaper 2025

7. Interacțiunea om-AI

O temere nespusă în vânzări B2B este: "Dacă clientul cumpără produsul recomandat de AI, eu îmi iau comisionul?" Pentru a preveni rezistența la noua tehnologie, agentul poate folosi recomandările AI ca fișă de produs instantanee, pentru a câștiga mai mulți clienți.

"Organizations can successfully implement AI by following best practices like identifying stakeholders, defining principles, [...] visibility, and implementing an AI training program."

Sursa: Google Cloud - Delivering trusted and secure AI Whitepaper 2025

Exemplu:

În abordarea Copilot, agentul primește comision integral, chiar dacă ideea a venit de la AI.

Pe scurt:

Stabiliți KPI ce pot fi urmăriți intern per contract, client, sau grup de clienți:

- Modificare AOV (valoare medie comandă) (%)

- Rata de click pe recomandări - în e-commerce (%)

- Timp mediu de ofertare (minute)

- Recomandări greșite (ex: stoc 0 / sub marjă / incompatibil, pentru guardrails)

- Tichete interne și externe legate de recomandări (pentru explicabilitate)

- Număr de angajați care folosesc AI (%)

- Metrici tehnice: NDCG@k (relevanța ordonării), Recall@k (relevanța căutării)

Ce să implementați?

Modelul consacrat astăzi folosește Deep Learning pentru a obține recomandări, upsell, cross-sell și înțelegerea secvenței de cumpărare, a conținutului produselor și a contextului clientului.

Această arhitectură este implementată de la zero de giganți e-commerce, inclusiv în România, fie inclusă în soluțiile gestionate, ca Vertex AI Search for commerce de la Google Cloud.

Tehnologie

Deep Learning folosește trei etape: una aproximativă (generare), una de re-ordonare și control (post-procesare), plus o etapă finală de feedback loop. Prima etapă are două creiere: unul care știe produsele și unul care știe clientul.

Diagramă logică simplificată

Etapele unui sistem de recomandări AI bazat pe Deep Learning:

| Sisteme de date | Sisteme pt. RecSys | Tehnologii aplicate |

|---|---|---|

| Pasul 1: Generarea candidaților (Retrieval) - abordarea two-tower | ||

|

Date companie: CRM, WMS, ERP, e-commerce (turn 1) |

Data warehouse (+ filtre simple de pre-procesare) Candidate Generation |

Vector databases / Vector search (FAISS / ScaNN) |

|

Date live client: istoric, detalii, oră vizită (turn 2) |

Streaming de date / Feature store |

Infrastructură: |

|

Separare: context, secvență, conținut |

Sequence modeling: RNN / Transformers / State Space Models |

|

| Pasul 2: Ranking: ordonare și scoring | ||

|

Candidați obținuți la Pasul 1 |

Scoring model |

Optimizare obiectiv, după sensibilitate la preț, evitare bias-uri |

|

Re-ranking prin guardrails, post-procesare |

Low-code (ex: Boost / Bury) Filtre deterministice Motor de constrângeri |

|

| Învățare continuă: feedback loop | ||

|

Feedback client: pozitiv: click / negativ: ascunde |

Data warehouse / Feature store / ML Ops Pipeline |

Re-antrenare continuă, |

Studiu de caz: Timp de ofertare -68%, +14% valoare medie comandă pentru distribuție

Upsell și cross-sell prin two-stage funnel și abordarea two-tower

1. Arhitectura standard

Mulți giganți din e-commerce-ul românesc dar și companiile care folosesc o abordare gestionată ca Vertex AI Search for commerce implementează această arhitectură cu două etape principale: generarea primilor candidați (Retrieval) și selecția lor atentă (Ranking)

Tehnologie "două turnuri" (en. two towers)

- Etapa de generare are două rețele neuronale distincte. Primul turn înțelege catalogul de produse (relativ stabil) și al doilea înțelege contextul clientului (foarte dinamic).

- AI face potrivirea semantică, măsurând distanța matematică între cele două turnuri.

- Arhitectura two-tower este standardul care face posibilă Gen 3 descrisă mai sus, mai ales în etapa de generare (en. Retrieval).

Dacă vă este frică de detalii tehnice, nu uitați că în 2026 puteți evita implementarea de la zero, vezi abordarea Managed în Cap. 2.4.

2. Etapa 1: Generarea candidaților (Retrieval)

Din milioanele de produse din catalog (eventual pre-procesate cu filtre de bază), un algoritm rapid selectează câteva sute relevante.

Tehnologie

Pentru căutare se folosesc tehnologii de Vector Databases (ex: Milvus, Qdrant, pgvector) / Vector Search (ex: librăria FAISS a Facebook / ScaNN a Google).

Două fluxuri de date au creat spațiul de căutare în prealabil:

- Produsele au fost transformate în vectori (embeddings), prin procesare batch (zilnic) sau streaming (aproape real-time) pentru produsele noi. Asemănarea fiind semantică, sinonimele (pe date curate) sunt înțelese automat: "bormașină" devine foarte apropiat de "mașină de găurit cu percuție".

- Prin modelare de secvențe (Sequence Modeling) și ingestie continuă, datele calde despre clientul care accesează sistemul ajung în același spațiu de căutare vectorială (aproape) real-time.

Avantaj: Pe ambele turnuri, sistemul caută vecinii cei mai apropiați, pentru a livra produsul potrivit clientului potrivit la momentul potrivit.

3. Etapa 2: Ranking (ordonare / scoring și post-procesare)

Din sutele de produse candidate, modelul trebuie să calculeze un scor numeric de probabilitate de conversie. De exemplu, pCVR: probabilitate de conversie (achiziție, acceptare ofertă, alt eveniment de succes). Acești candidați ajung primii.

Tehnologie

- Produsele generate sunt trecute printr-un model complex (ex. gradient boosted trees sau DCN: Deep & Cross Network) pentru scoring.

- În etapa următoare se aplică guardrails (reguli de siguranță) pentru re-ranking.

- Guardrails pot fi scrise de programatori (ex: Python sau motoare de reguli ca Drools) în Build sau configurate manual (sau JSON) în consolă ca Serving Controls în Managed.

Regulile de business (guardrails) care se aplică la final în post-procesare sunt esențiale pentru controlul AI (vezi detalii în Cap. 2.5.1):

- Asigură alinierea cu politica comercială: unele scoruri sunt ajustate, unele rezultate sunt eliminate.

- Exprimă prioritatea regulilor de business deterministice față de non-determinismul AI.

Exemplu de reordonare:

Echipele de vânzări B2B deseori recomandă produsul cu probabilitate de cumpărare dar care are simultan marja cea mai bună și care este și disponibil.

Pentru a păstra logica, în etapa de post-procesare, poți prelua primele produse ordonate după pCVR și să compari marja, să verifici stocul și apoi să le reordonezi.

4. Upsell, cross-sell, discounting

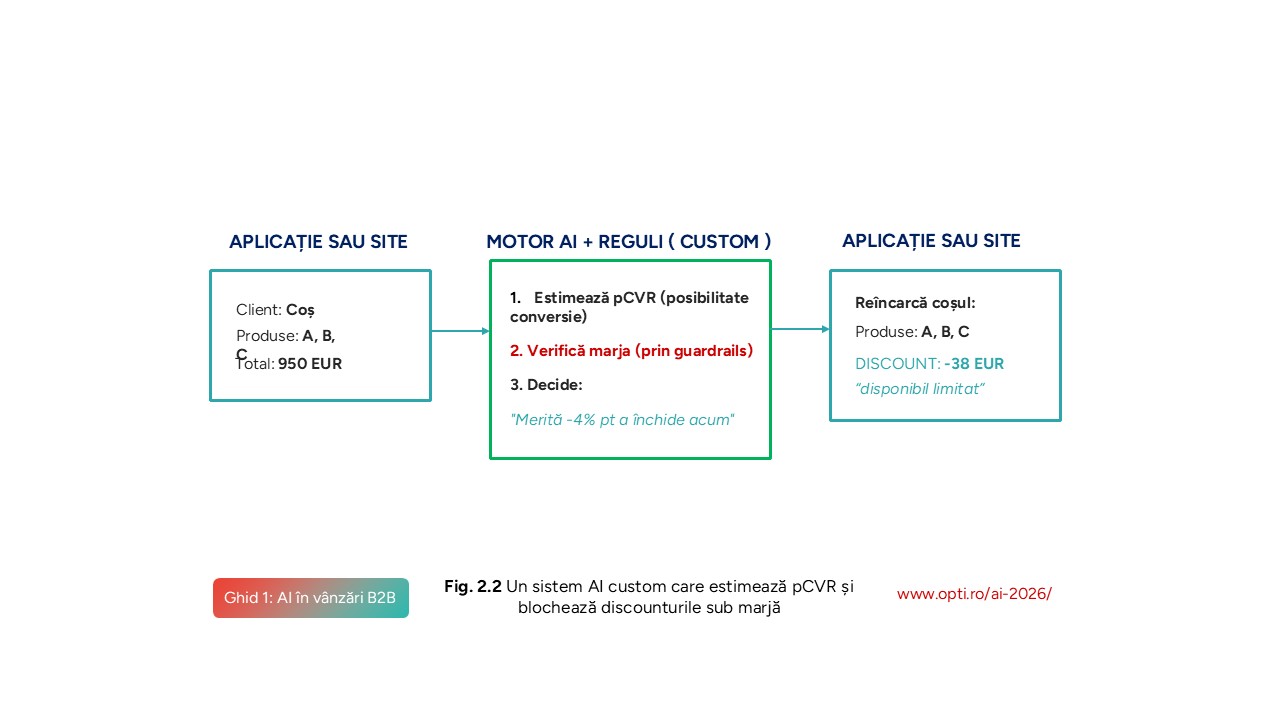

APLICAȚIE SAU SITE MOTOR AI + REGULI (CUSTOM) APLICAȚIE SAU SITE

┌───────────────────┐ ┌──────────────────────┐ ┌─────────────────────┐

│ Client: Coș │ │ 1. Estimează pCVR │ │ Reîncarcă coșul: │

│ Produse: [A, B, C]│ ───► │ (probabilitate │ ───► │ │

│ Total: 950 EUR │ │ conversie) │ │ - Produs A │

└───────────────────┘ │ 2. Verifică marja │ │ - Produs B │

│ (prin guardrails) │ │ - Produs C │

│ 3. Decide: │ │ [DISCOUNT: -38 EUR] │

│ "Merită -4% pt a │ │ (disponibil limitat)│

│ închide acum" │ └─────────────────────┘

└──────────────────────┘

Upsell: upgrade

Se bazează pe caracteristici și atribute de produs. Pentru un laptop de 1.200 EUR, modelul poate împinge în ranking laptopuri cu specificații similare dar marginal mai bune (și cu marjă mai bună), pentru că a învățat: clienții care compară specificațiile tind să facă upgrade.

Cross-sell: accesorii

Se bazează pe reguli de compatibilitate întărite de date comportamentale.

De exemplu, vectorul unui excavator este asociat puternic tranzacțional cu vectorul kit-ului de filtre hidraulice specific (pentru mentenanță). Aceasta este prima fundație pentru livrabilul #8: Motor de compatibilitate tehnică.

Cealaltă fundație este un sistem de compatibilități exacte între produse pentru care aveți nevoie de fișe tehnice detaliate și să precizați în guardrails filtrele (ex: ce câmpuri trebuie să fie identice).

Vezi generarea unui Bill of Materials (BOM) cu tehnologii avansate în Noutățile AI

Discounting: optimizare preț

Arhitectura poate trata discountul ca variabilă de optimizare conversie. De fapt, modelele AI vor estima în spate probabilitatea de conversie pentru fiecare scenariu.

Exemplu tactic: Dacă clientul e sensibil la preț, un discount mic poate debloca o comandă de volum.

Exemplu cu prag dinamic: Dacă clientul mai adaugă produse de X EUR, va debloca discount de 5%.

Aceasta este fundația pentru livrabilul Optimizare dinamică preț din Cap. 3. În soluțiile Managed, această logică e adesea custom (componentă separată).

Contextul clientului și modelarea secvenței

Diferența majoră dintre filtrarea colaborativă (Gen 2) și recomandările Deep Learning (Gen 3 - actuală) este capacitatea de a înțelege intenția imediată, nu doar istoricul.

1. Modelarea secvenței sesiunii (en. Sequence Modeling)

Arhitectura actuală nu se uită doar la istoricul global, ci la sesiunea curentă.

Tehnologie

Folosește modele de tip RNN (Recurrent Neural Networks) sau arhitecturi bazate pe Transformers (similar cu ChatGPT, dar pentru click-uri, nu cuvinte) sau State Space Models (tehnologie nouă mai rapidă). O extensie populară este prognoza temporală (en. time-series modeling)Exemplu B2C

Dacă s-a adăugat un telefon în coș, vectorul de context se schimbă instantaneu. Următoarea recomandare nu va mai fi un alt telefon (deși asta căuta acum 5 minute), ci accesorii, pentru că modelul a învățat secvența logică:

Vizualizare telefon Adăugare coș Căutare huse

Exemplu B2B cu prognoză temporală

AI poate învața cadența comenzilor. Dacă un client cumpără toner la fix 45 de zile, sistemul trimite recomandarea în ziua 42, exact înainte ca clientul să caute alt furnizor.

La prima vedere, nu este nevoie de AI pentru acest caz simplu (puteți lua media simplă a distanței între comenzi). Dar dacă unii clienți au sezonalitate reală (ex: o fermă comandă doar toamna și iarna), AI va găsi și aceste tipare.

2. Contextul de dispozitiv și timp

Datele calde despre client (ora sesiunii, dispozitivul folosit) sunt esențiale pentru a recomanda clientului ce dorește el acum.

Tehnologie

- Datele despre client devin variabile (Features) care intră în rețeaua neuronală alături de ID-ul produsului.

- Ele se trimit într-un Feature Store (colecție de variabile pentru AI) și modelul va primi inputuri structurate:

-

[User_id, Product_id, Time_of_day, Device_type, Last_5_actions]

Exemplu: Dacă intri de pe mobil seara, modelul poate favoriza conținut ușor de consumat sau decizii rapide, față de accesul de pe desktop în timpul orelor de program (achiziții B2B).

În e-commerce-ul foarte specializat, contextul este asigurat și prin guardrails, definite manual pentru optimizarea sesiunii curente de cumpărare.

Exemplu B2B: Dacă ai un procesor AMD în coș, banda de alte produse recomandate din coș poate să fie forțată să recomande doar produse AMD.

Ingestie și flux (aproape) real-time

Calitatea recomandărilor variază direct cu calitatea și viteza datelor de intrare (principiul GIGO: Garbage In, Garbage Out).

Pentru ca modelul AI să fie relevant, datele trebuie să fie curate și corelate în prealabil.

Pentru B2B recomandăm

unificarea datelor din toate sursele

și ingestie continuă prin

API.

Vezi în Ghidul #2 cum construim sursa unică de adevăr pentru a alimenta corect algoritmii

1. Catalogul de produse (Sursa principală: ERP, Surse secundare: WMS, PIM, e-commerce)

Sunt date fundamentale ale companiei. AI poate avea acces nu doar la numele produsului, ci și metadatele critice pentru business, în special preț și stoc.

Date necesare (ERP / WMS)

Titlu, Specificații tehnice (ex: dimensiuni normalizate), Coduri OEM / coduri echivalente, Stoc (adesea per locație), Marjă, Imagini, Vechimea stocului etc.

AI trebuie să știe că 'Filtrul X' este echivalent tehnic cu 'Filtrul Y' pentru a putea realiza livrabilul Smart Substitutes din Cap. 3.

Transfer către AI

Prin API / cozi / import de fișiere (CSV) / CDC / RPA. Orice modificare de preț sau stoc în ERP (ex: SeniorERP / Charisma / Entersoft) poate fi transmisă aproape instantaneu (cu acces la date).

Pentru relevanță, se pot actualiza incremental (ex: API Patching)

Exemplu: Dacă stocul devine 0 la ora 14:00 și recomandarea trebuie să dispară la 14:01, ingestia batch (o dată pe zi) ar risca să recomande produse indisponibile timp de 24 de ore. Regulile comerciale (guardrails) pot bloca în orice caz acest efect.

Re-antrenarea modelului de recomandări poate avea loc zilnic, procesând cantități mari de date pentru toate produsele.

2. Istoricul de client (Sursa principală: CRM)

AI trebuie să știe cine este clientul:

- Înainte de a face prima interacțiune în secvență (ex: click) sau să i se transcrie cererea de ofertă.

- Continuu de-a lungul fluxului lui de cumpărare (vezi Cap.4.3.2)

- Cu agregare corectă pe unitate de măsură. Agregarea în B2B se face după account, companie sau contract. De exemplu, după CUI (număr de identificare fiscală), nu email ca în B2C.

Cu generalizarea LLM, este posibilă și ingestia datelor nestructurate: se transcriu permanent apelurile de vânzări și mailurile trimise, apoi se obține o cifră de sentiment sau acțiune recomandată (en. next best action) care poate fi scrisă înapoi în CRM.

Studiu de caz: Analiză financiară de sentiment cu GenAI & Google Cloud

Date necesare

Achizițiile din ultimele 12-24 luni, alte date: locația, dimensiunea afacerii, date nestructurate (apeluri, mailuri)

Transfer către AI

Profilul din CRM (ex: HubSpot / Salesforce / Pipedrive) al clienților poate fi injectat (ETL) în contextul AI, de exemplu prin taguri către API în varianta Managed sau printr-un nou segment în varianta Build.

Exemplu: dacă un client este revânzător, algoritmul poate prioritiza automat componentele, nu produsele finite. Dacă agentul A al firmei X cumpără țevi, AI va recomanda agentului B din aceeași companie X fitinguri, chiar dacă agentul B nu a mai cumpărat înainte.

3. Evenimente live și clickstream (Sursa: e-commerce, alte aplicații ale companiei)

Sunt date imediate și cel mai puternic factor de predicție pentru intenția de cumpărare, cel puțin în e-commerce.

Date necesare

Evenimente de tip detail-page-view, add-to-cart, remove-from-cart, purchase-complete.

Transfer către AI

Spre deosebire de un sistem de tracking (ex: Google Analytics) care doar raportează, acest transfer antrenează implicit modelul AI de recomandări.

Flow de ingestie date live (e-commerce)

Pentru clickstream se folosesc sisteme ca Apache Kafka sau Spark în varianta Build, respectiv API (userEvents) în varianta Managed

La click pe produs, se trimite un eveniment într-un Feature Store, respectiv prin API.

Când încarci următoarea pagină, sistemul interoghează Feature Store-ul: "Care sunt ultimele 5 click-uri ale acestui client?" și modelul va lua în considerare contextul actualizat.

Se previn astfel recomandările vechi (en. stale). Aplicația (UX) poate pivota direct către cross-sell. Va recomanda de exemplu extensie de garanție sau accesoriu.

Relevanța continuă, garantată de latența redusă (milisecunde în scenarii optimizate) justifică de ce comanda medie în e-commerce cu personalizări și recomandări AI poate crește cu 15%. Vezi indicator McKinsey în Cap. 1.

Note: Pentru succesul implementării AI peste datele companiei, vezi Contractul de date și regulile de business din Cap. 2.5 pentru:

-

Curățarea datelor și evitarea

GIGO - Protecția prețurilor, stocurilor și permisiunilor companiei

Explicabilitatea AI (xAI)

Rețelele neuronale folosite în arhitecturile custom sunt în mare parte black box (cutii negre). Operatorul uman nu știe exact de ce produsul X a fost recomandat clientului A acum.

Se folosesc strategii de reducere a riscurilor.

A/B testing

Nu încercăm să ghicim de ce a mers, ci măsurăm dacă a mers.

- Framework-urile de A/B permit ca 50% din clienți să vadă algoritmul A și 50% algoritmul B. Varianta Managed (Google) are funcție nativă Experiment.

- Decizia va fi luată pe KPI comerciali: revenue, CTR.

- Pentru management, de obicei e suficient să vadă că varianta B aduce +X% venit.

În B2B:

- Numărul de clienți este mai mic, uneori fără relevanță statistică.

- O strategie recomandată este testarea per client (Account-Based Testing). Activați recomandările AI pentru segmentul IMM (en. SMB) de clienți și măsurați rezultatele înainte de a-l activa pentru clienții strategici. Nu uitați să aplicați strategia simultan pe toate canalele pe care interacționați cu clientul.

- În Cap. 4 recomandăm să rulați algoritmii în Shadow Mode (folosire internă) înainte de orice lansare externă.

Vezi metodologia de A/B testing automatizat și feedback loops în Ghidul #5.

Unelte pentru echipele tehnice în varianta Build

Vizualizare offline (t-SNE, UMAP)

Inginerii de date pot analiza grafice 2D/3D ale vectorilor / embeddings pentru a vedea dacă produsele s-au grupat. Ex: dacă tigăile stau lângă ulei, modelul a învățat corect.

Feature importanceSe pot face analize pentru a vedea care variabilă a contat mai mult (ex: preț, brand, secvență click), dar rar în real-time. Se pot obține SHAP values (sampled) și în Google Cloud există Feature Attribution pentru Custom Models și AutoML (modele personalizate)

Unelte Explainable AI în varianta Managed

În Vertex AI Search for commerce (modul de recomandare), doar la conectarea Conversational Commerce (nouă, vezi Ghidul #4), poți obține direct explicația în limbaj natural produsă de LLM. În modalitatea clasică, poți obține doar un scor numeric de relevanță a recomandării, în pagina de Evaluate din dashboard.

Feature importanceÎn Vertex AI Search și Vertex AI Search for commerce (modul de căutare) există dashboard vizual de explicabilitate cu explicații textuale, vezi Ghid #4 pentru căutarea cu AI.

Pe scurt:

- Sistemul lucrează în doi pași: găsește mulți candidați, apoi îi ordonează inteligent și îi prioritizează sau filtrează cu regulile companiei (guardrails).

- Calitatea datelor și a codurilor de produs contează la fel de mult ca modelul AI.

- Implementarea AI cere teste și pilot intern (Shadow Mode) pentru a avea succes.

Comparație între abordarea Build și Managed

În vânzările business to business, provocarea este gestionarea unui catalog vast, suplimentat deseori cu produse noi fără istoric (problema Cold Start) și respectarea regulilor stricte de business (ex: nu recomanda produse ieftine clienților premium)

Comparăm construcția propriilor modele (data science in-house) cu utilizarea modelor pre-antrenate, cum ar fi în Vertex AI Search for commerce. Cum recomandăm un produs complementar alături de "Centrală termică 24kW" în cele două abordări?

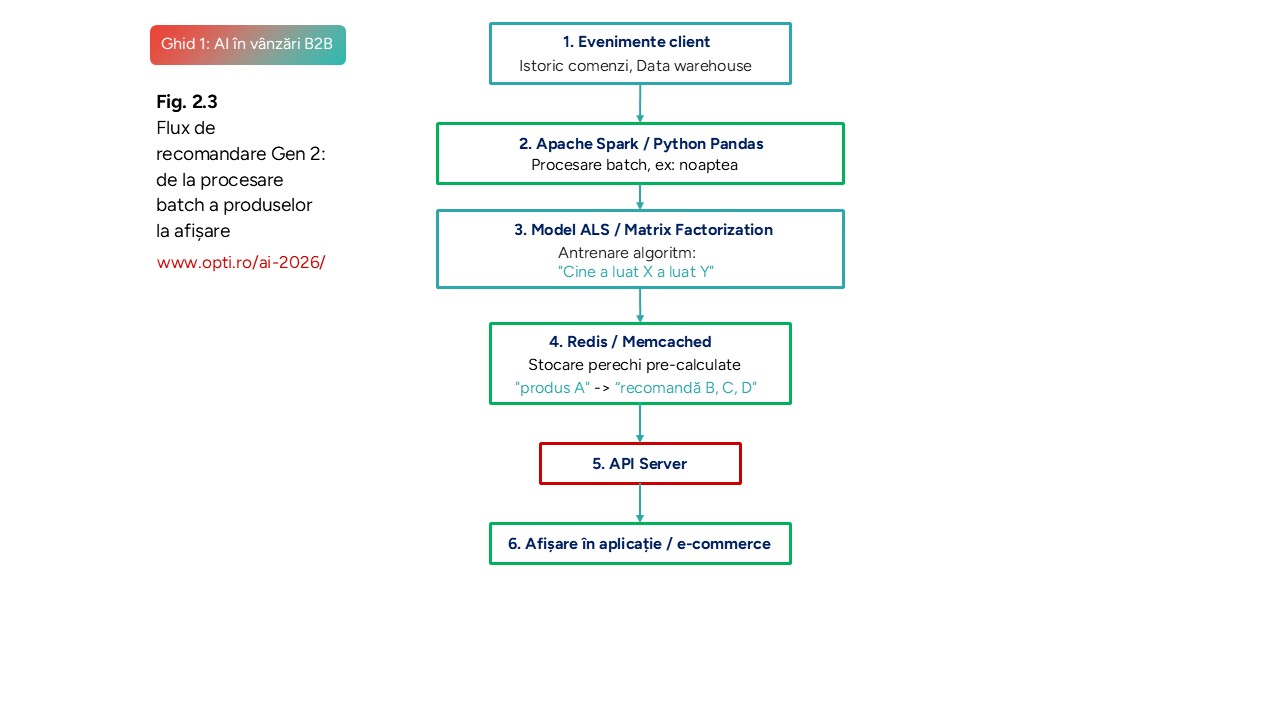

Build: Arhitectura custom (DIY / agnostică tehnic)

Este abordarea clasică de data science. Veți dezvolta un model de Deep Learning (Gen 3). Pentru simplitate ilustrăm cu Gen 2 un flux simplificat de filtrare colaborativă cu tehnologii open-source:

1. EVENIMENTE CLIENT

(Istoric comenzi, Data warehouse)

│

▼

2. APACHE SPARK / PYTHON PANDAS

(Procesare batch, ex: noaptea)

│

▼

3. MODEL ALS / MATRIX FACTORIZATION

(Antrenare algoritm: "Cine a luat X a luat Y")

│

▼

4. REDIS / MEMCACHED

(Stocare perechi pre-calculate.

Ex: "produs A" -> "recomandă B, C, D")

│

▼

5. API SERVER

│

▼

6. AFIȘARE în APLICAȚIE / E-COMMERCE

Avantajul este proprietatea asupra codului dezvoltat (de obicei) și posibilitatea implementării oricărui tip de învățare.

Există modele specializate de prognoză temporală (en. time-series modeling) care pot fi folosite în cloud (ex: Vertex AI Forecast), și multe tipuri de modele în Model Garden (open-source ca Llama / Mistral sau comerciale ca Gemini). Acestea pot fi conectate la datele și restul logicii dezvoltate de echipă.

Ca infrastructură, abordarea Build necesită provizionarea și mentenanța serverelor (ex: Kubernetes), fie in-house, fie într-un cloud ca Google Cloud, urmând să plătiți pentru infrastructură (IaaS - Infrastructure as a Service).

Ca limitări, deoarece calculul matricial este intens, se face de obicei o dată pe zi (batch). Dacă un produs devine brusc popular la ora 10:00, este nevoie de o logică specială (care este realizabilă) pentru a actualiza recomandările înainte de următorul batch, altfel algoritmul nu se va ajusta până a doua zi.

Estimare de efort și timp:- Echipă: Dezvoltator, inginer de date/ML, inginer DevOps, analist de business

- Dezvoltare model: 2-3 luni (cu iterări necesare pentru acuratețe).

- Infrastructură (evenimente, modele, API): 1-2 luni.

- Total până la lansare: de la 4-6 luni.

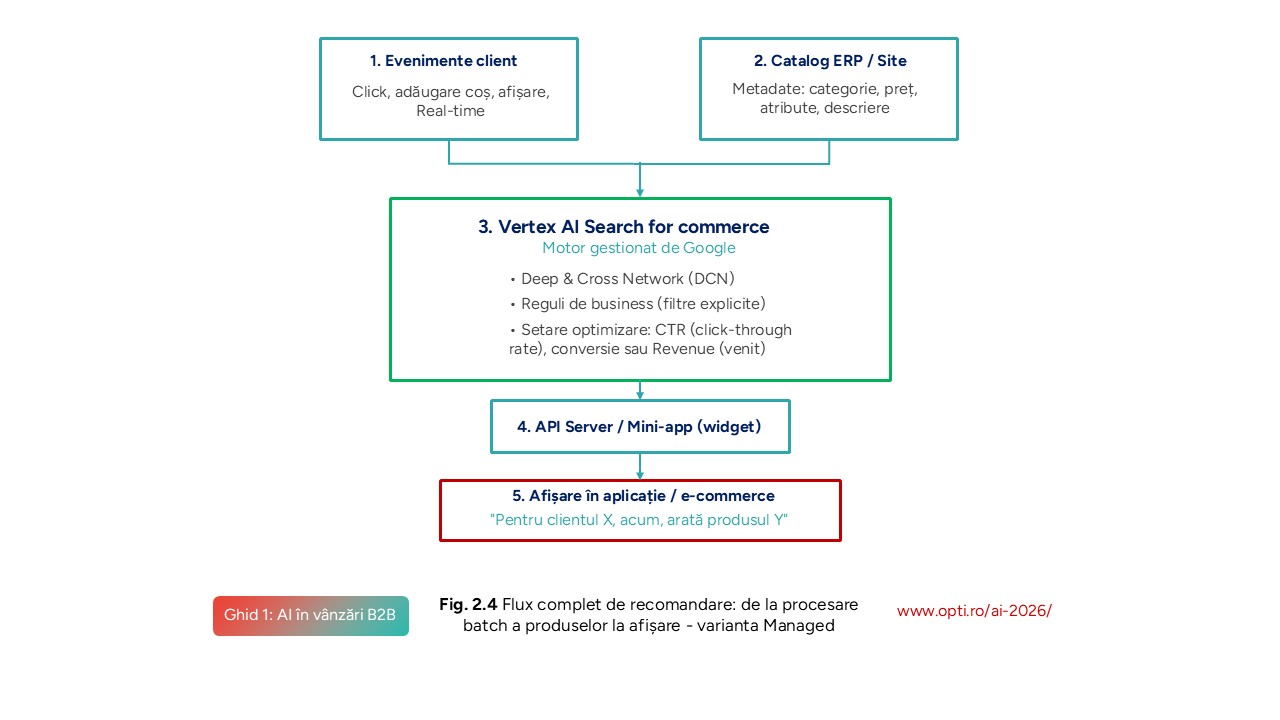

Managed: Arhitectura Cloud Native (Google)

Este o abordare în care modelul AI este complet gestionat extern. Folosim un serviciu ca Vertex AI Search for commerce, care include modele de Deep Learning cunoscute în piață a fi similare cu Google Shopping sau YouTube.

1. EVENIMENTE CLIENT 2. CATALOG ERP / E-COMMERCE

(Click, adăugare coș, (Metadate: categorie, preț,

afișare, real-time) atribute, descriere)

│ │

└──────────────┬──────────┘

▼

3. VERTEX AI SEARCH FOR COMMERCE

(Motor gestionat de Google)

┌────────────────────────────────────────┐

│ • Deep & Cross Network (DCN) │

│ • Reguli de business (filtre explicite)│

│ • Setare optimizare: CTR (click-through│

│ rate), conversie sau Revenue (venit) │

└────────────────┬───────────────────────┘

│

▼

4. API SERVER/MINI-APP (WIDGET)

│

▼

5. AFIȘARE ÎN APLICAȚIE / E-COMMERCE

("Pentru clientul X, acum, arată produsul Y")

Avantajul este rezolvarea la pachet a problemei lipsei de istoric (Cold Start) și a comparației semantice. Dacă apare un produs nou în ERP (ex: "Bormașină model 2026") cu toate specificațiile, algoritmul îi indexează atributele (ex: putere, brand, categorie) și chiar imagini. El îl va recomanda clienților care caută produse similare și, în plus, în piață algoritmii Google sunt cunoscuți ca fiind excelenți pentru clienții noi fără istoric.

Ca limitări, produsul nu include acum unele tipuri de învățare, de exemplu prognoză temporală (en. time-series modeling) pentru cadență sau logică de discounting. Acestea necesită implementare orchestrată în middleware-ul de control. Se pot folosi inclusiv modele din Google Cloud, de exemplu din Model Garden.

În al doilea rând, nu ai acces la codul modelelor Managed, dar poți configura obiectivele lor din lista disponibilă în consolă (ex: maximizare CTR sau Revenue / session).

Estimare de efort și timp:- Echipă: Dezvoltator, Inginer de date, analist de business

- Sincronizare catalog (dacă datele sunt curate): 2-3 săptămâni.

- Infrastructură (evenimente, API): 1-2 săptămâni.

- Antrenare inițială: 1-2 săptămâni (automată).

- Total până la lansare: de la 2-3 luni.

Tabel comparativ

| Criteriu | Build: arhitectură agnostică (custom) | Managed: Vertex AI Search for commerce (Cloud Native) |

|---|---|---|

|

Adaptabilitate |

Medie. De obicei necesită re-antrenare (batch) pentru trenduri noi. |

(Aproape) real-time. Învață în sesiune (la click, recomandările se schimbă) |

|

Tehnologii |

In-house și open-source. Ex: TensorFlow/PyTorch, Vector Databases / Vector Search. |

Modele pre-antrenate de Google, cu obiective configurabile, accesibile prin |

|

Infrastructura |

De obicei, în cloud (inclusiv Google Cloud) prin tehnologii ca Databricks, plătit la consum. |

Google Cloud, plătit în principal la evenimente de business (interogări, predicții, training) |

|

Context |

Sesiune curentă + istoric. Modele secvențiale (ex: Transformers). |

|

|

Explicabilitate (xAI) |

Medie (scăzută în timp real). Se bazează pe metrici offline. |

Limitată, prin Conversational (pentru recomandări). Mai ridicată pentru căutare. |

|

Date noi |

Arhitectură necesară (Kafka/Spark) pentru a injecta click-ul recent în model. |

Gestionat automat după trimitere eveniment în |

|

Produse noi (Cold Start) |

Necesită efort. Posibil cu folosirea unui Feature Store. |

Funcțional. Folosește metadate, chiar imagini, dar și pre-antrenarea modelului. |

|

Tipuri de învățare (obiective) |

Implementare individuală. Se poate dezvolta orice model. |

Modele și obiective predefinite. Necesită implementare custom pentru altele. |

|

Reguli de business |

Necesită cod custom ("IF brand = X THEN…"). |

Parțial administrabile prin Consolă vizuală / JSON pentru Boost, Bury, Filter. |

|

Dependență critică |

Echipa de implementare. De obicei ai acces la codul sursă. |

Tehnologie matură, fără acces la codul sursă. Specializat pe relevanță de produs. |

|

Mentenanță |

Monitorizare constantă modele (pentru drift). Poți face debugging. |

Tuning automat al modelelor. |

|

Permit asistenți chatbots? |

Bineînțeles, vezi Ghidul #4 |

|

Construirea unui sistem de recomandări de la zero (varianta Build) este o opțiune pentru companiile cu volum mare de trafic și nevoie de control pe cod.

Construirea cu Vertex AI Search for commerce (varianta Managed) este o opțiune pentru implementare rapidă. Componentele care nu sunt disponibile, de exemplu prognoză temporală, pot fi implementate custom.

Pe scurt:

- Varianta Build necesită echipă ML matură de dezvoltare.

- Varianta Managed (Cloud Native) permite unei companii să folosească algoritmi consacrați dar proprietari rapid.

- În ambele cazuri, este necesară programarea sau configurarea suplimentară pentru a garanta că sistemul respectă regulile comerciale (ex: stoc, marjă).

- În practică, unele companii folosesc o abordare hibridă, pe cazuri de utilizare diferite și cu componente diferite.

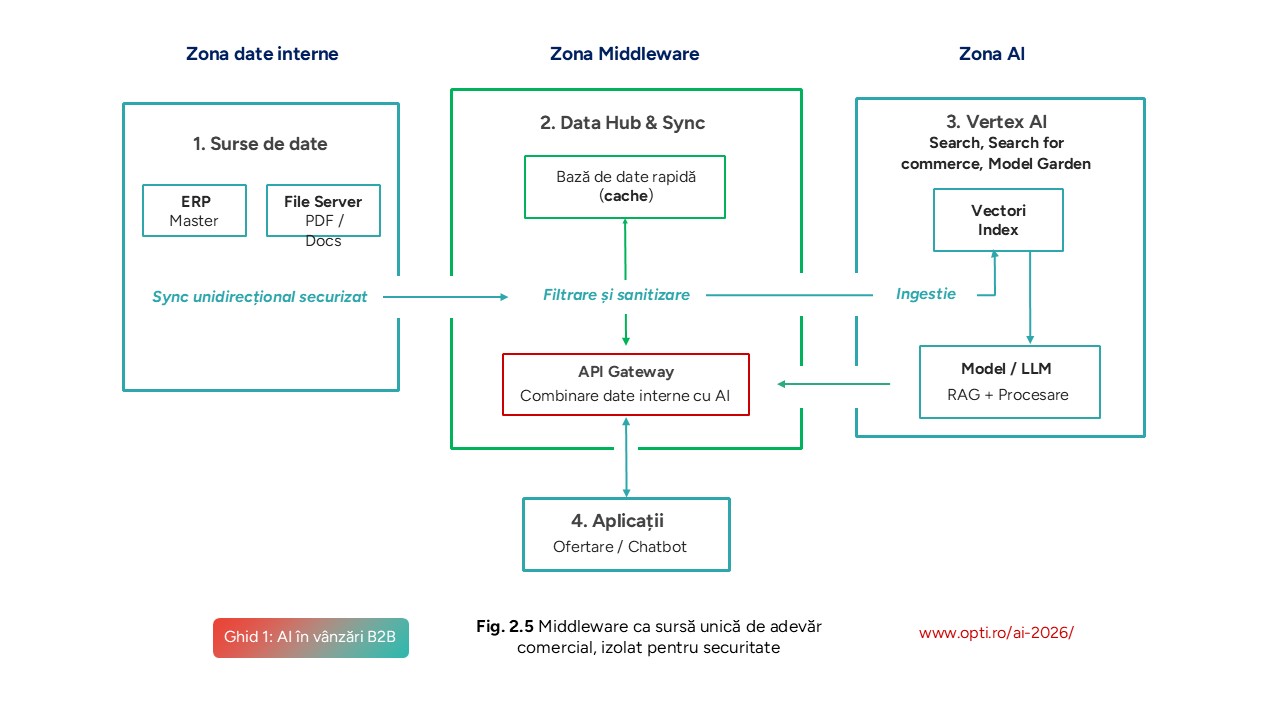

Model hibrid cu middleware "privacy-first"

Pentru companiile cu cerințe stricte de securitate sau cu sisteme ERP on-prem, ilustrăm din proiectele OPTI Software cum arată un middleware centralizat pentru adevăr comercial.

Poate funcționa în cloud sau on-prem și se conectează punctual la funcțiile de AI, fie gestionate de Google, fie custom via Model Garden.

ZONA DATE INTERNE ZONA MIDDLEWARE ZONA AI

┌─────────────────────────────────┐ ┌───────────────────────────────┐ ┌───────────────────────────┐

│ 1. SURSE DE DATE │ │ 2. DATA HUB & SYNC │ │ 3. Vertex AI (Search + │

│ │ │ │ │ Search for commerce, │

│ │ │ │ │ Model Garden) │

│ ┌────────────┐ ┌────────────┐ │ │ ┌─────────────────────────┐ │ │ ┌───────────────────────┐ │

│ │ ERP │ │ FILE SERVER│ │ │ │ Bază de date rapidă │ │ │ │ Vectori │ │

│ │ (Master) │ │ (PDF/Docs) │ │ │ │ (Cache) │ │ │ │ Index │ │

│ └──────┬─────┘ └─────┬──────┘ │ │ └────────────┬────────────┘ │ │ └───────────▲───────────┘ │

│ │ │ │ │ │ │ │ │ │

│ ▼ ▼ │ │ ▼ │ │ │ │

│ [Sync unidirecțional securizat]├─────►│ [Filtrare și sanitizare] ├─────►│ [Ingestie (doar public)] │

└─────────────────────────────────┘ │ │ │ │ │

│ │ │ │ ┌───────────────────────┐ │

│ ┌────────────▼────────────┐ │ │ │ Model / LLM │ │

│ │ API Gateway │◄─┼──────┤ │ (RAG & Procesare) │ │

│ │ (Combina interne cu AI) │ │ │ └───────────────────────┘ │

│ └────────────▲────────────┘ │ └───────────────────────────┘

└───────────────┼───────────────┘

│

▼

┌─────────────────────────┐

│ 4. Aplicatii │

│ (Ofertare / Chatbot) │

└─────────────────────────┘

| Caracteristică | Checklist |

|---|---|

|

Inteligență |

|

|

Minim de date și separabilitate |

|

|

Securitate |

|

-

Google Cloud oferă criptare implicită in-transit (

TLS) la transfer de date. -

Google Cloud suportă

CMEK(Customer-Managed Encryption Keys) pentru datele at-rest (stocate). Compania poate avea cheile de criptare ale indexului. Revocarea cheilor face datele criptate neutilizabile. - Instrucțiunile oficiale pentru Vertex AI Search for commerce cer ca implementarea să nu trimită date de identificare a persoanelor (en. PII). Cer așadar arhitectură hibridă.

Arhitectură comparată: Soft de ofertare Vânzări cu AI de la OPTI

Configurare vizuală: Business user controls

În Vertex AI Search for commerce,

integrarea API-ului în aplicație și construcția livrabilelor necesită programatori, dar strategia de vânzare se poate defini parțial din interfață (low-code).

1. ServingConfigs: Constructorul de reguli

Vrei să lichidezi stocurile de iarnă? Pentru Vertex AI Search for commerce există un editor vizual pentru reguli de business. Poate fi folosit de analiști sau power users care știu schema de date (câmpurile) și formatul JSON. Construiești un ServingConfig ce poate avea:

- Filter (Excludere): Selectezi "Exclude produse fără imagine" pentru a proteja brandul.

- Boost (Promovare): Selectezi condiția categorie = "iarnă" și muți slider-ul la +50%. Produsele vor apărea mai sus în recomandări.

- Bury (Retrogradare): Selectezi stoc < 5 cu Bury dacă vrei să trimiți produsele cu stoc mic la finalul listei.

- Pot fi programate în avans. Setezi să fie active doar de 10 martie sau doar de Black Friday.

- Pot fi testate sau simulate Ecranul Evaluate îți permite să testezi efectul pentru anumiți parametri (user, moment de timp, produse) fără a-l activa.

Atenție la logica controalelor pentru a nu ajunge la configurări ineficiente sau contradictorii.

De exemplu:

Când produsele din cat. X au stoc real < 5 , o regulă de Boost X plus una de Bury stoc < 5 rezultă în zero efect.

2. Pinning: Campanii definite manual

Uneori, un anumit produs (ex: nou model lansat de furnizor) trebuie să fie obligatoriu primul recomandat, indiferent de AI. În dashboard poți crea un Pinning control.

- Cauți produsul după nume în consolă și îl lipești (pin) pe poziția 1 în widget-ul de Recomandate pentru tine.

- AI va completa restul listei (ex: pozițiile 2-10)

3. A/B Testing din câteva click-uri

Pentru a compara dacă modelul "Others You May Like" vinde mai bine decât "Frequently Bought Together", nu trebuie modificată aplicația companiei.

- Creezi un experiment în dashboard.

- Selectezi "Model A" vs "Model B".

- Google împarte traficul automat și va genera grafice comparative (ex: Revenue Uplift).

- Poți apăsa "Apply Winner" pentru a trece câștigătorul în producție.

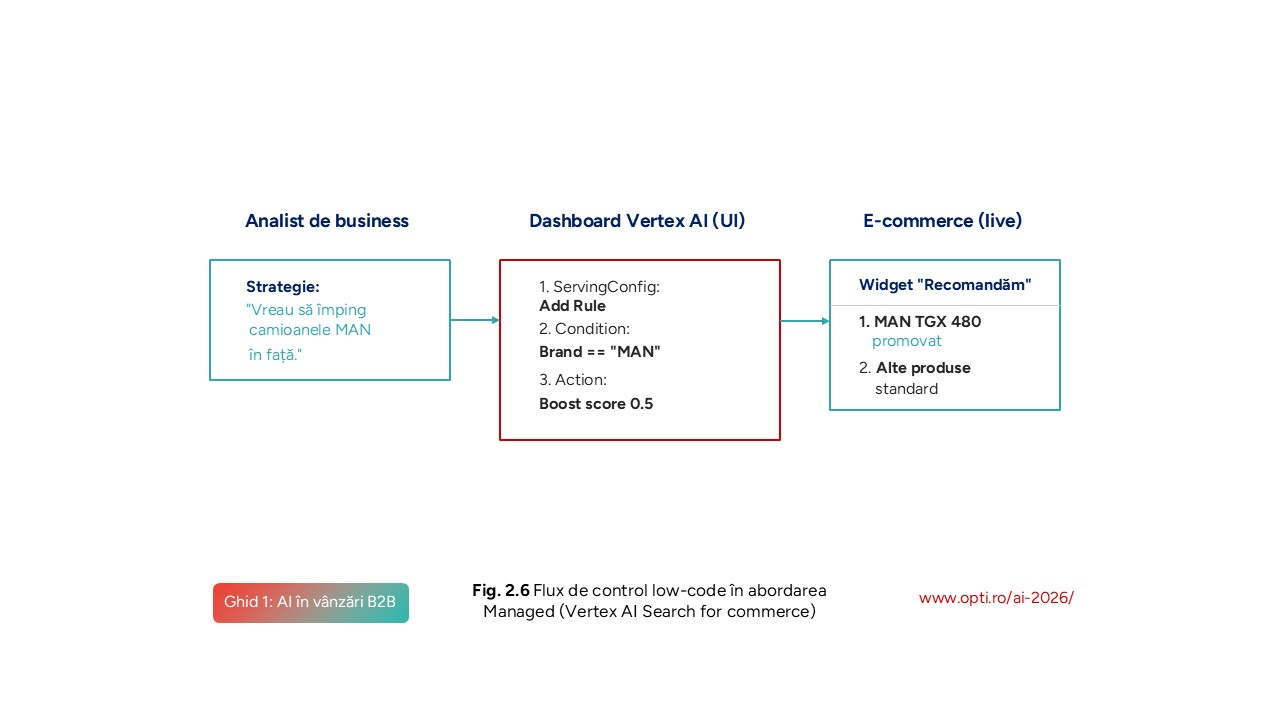

Fluxul de control low-code/no-code:

ANALIST DE BUSINESS DASHBOARD VERTEX AI (UI) E-COMMERCE (live)

┌──────────────────────┐ ┌──────────────────────┐ ┌─────────────────────┐

│ Strategie: │ │ 1. ServingConfig │ │ Widget "Recomandăm" │

│ "Vreau să împing │ ──►│ [ Add Rule ] │ ───► │ │

│ camioanele MAN │ │ 2. Condition: │ │ 1. MAN TGX 480 │

│ în față." │ │ Brand == "MAN" │ │ (promovat) │

└──────────────────────┘ │ 3. Action: │ │ 2. Alte produse │

│ Boost score 0.5 │ │ (standard) │

└──────────────────────┘ └─────────────────────┘

Pentru un departament comercial cu un analist tehnic, regulile de afișare pot fi controlate din dashboarduri, folosind controale vizuale. Trainingul și comunicarea cu echipa tehnică sunt esențiale pentru evitarea configurărilor greșite, riscurile fiind considerabile.

Reguli de business (guardrails) și contractul de date

Implementarea AI este primul pas. Sistemele care chiar vând în B2B sunt definite de control. Regulile deterministice de business îmblânzesc algoritmii probabilistici AI.

Guardrails: Reguli de business și post-procesare

Nu vrem să vindem sub marja minimă, să recomandăm produse imposibile / incompatibile sau să lăsăm clientul sau agentul de vânzări fără sugestie când integrarea AI nu funcționează.

Abordarea hibridă nu înseamnă doar date proprii plus AI în cloud, ci și AI predictiv sau agentic (Gen 3-4) controlat de reguli explicite ca în Gen 1. Scopul folosirii datelor companiei este de a controla rezultatul AI. Regulile sunt plasa de siguranță a afacerii.

1. Protecția afacerii

Regulile sunt invizibile pentru client, dar critice pentru departamentul financiar sau marketing:

Ce protejăm?

- Marja comercială: Nu recomanda produse cu un adaos comercial sub X%, chiar dacă sunt populare.

- Lichiditatea: Prioritizează produsele din stocul disponibil (en. Slow-moving) sau prioritizează un depozit apropiat de client, pentru a elibera capitalul de lucru. Dacă produsul cerut are stoc 0, guardrails permit activarea automată a livrabilului Smart Substitutes din Cap. 3, afișând alternativa tehnică validă (conform fișei de specificații).

- Poziționarea: Dacă ești un brand premium, nu vei recomanda produse entry-level (prea ieftine), pentru a nu dilua valoarea coșului.

- Protecția relației: Dacă clientul este B2B, elimină din recomandări produsele din gama "Hobby/DIY", chiar dacă sunt în general populare.

În special pentru upsell în B2B, regulile sunt esențiale pentru a nu încălca contractul, care poate prevedea, de exemplu, doar anumiți producători agreați.

Modelele AI pot învăța corelații greșite, ducând la recomandări repetitive sau absurde. Unui client de volum care a cumpărat o flotă de laptopuri Apple nu trebuie să i se recomande genți și accesorii Asus.

Soluția sunt regulile de excludere bazate pe metadate, care encodează expertiza umană.

Exemplu: Dacă primele 3 produse sunt din același brand și subcategorie, forțează inserarea unui produs de la alt brand pe poziția 4.

2. Fallback: Continuitatea experienței

Ce se întâmplă dacă API-ul are o latență, dacă clientul este nou (fără istoric) sau dacă pentru un

produs

obscur nu există recomandare de încredere (ex: scor > 0.5 derivat în abordarea Build)?

Arhitectura hibridă asigură continuitatea:

- Definiți un fallback (ex. best-sellers / categorie)

- Când sistemul AI nu returnează rezultate sau când ele nu au încredere ridicată (în acest caz varianta Managed include de obicei fallback automat), puteți afișa "Cele mai vândute produse", pe baza unei interogări clasice de bază de date SQL.

- Nu va exista spațiu gol în interfață.

3. Sisteme expert: Oamenii pot ști mai bine

Deși AI este puternic, el poate ști prea puțin (en. underfitting) despre contextul comercial complet. Managerul poate trece peste (en. override) recomandările AI.

Forțarea campaniilor:

Pentru campaniile noi unde nu există date contextuale relevante, se pot defini perioade de promovare (ex: Boost) cu forțarea priorității.

Exemplu: Compania va lansa mâine (ex: 12 decembrie) un discount de 12,12% la o categorie nouă, dar AI nu va ști să promoveze acea categorie, dacă nu are în context prioritatea pentru business a campaniei.

Sezonalitatea:

Calendarul uman diferă de statistica pură, de exemplu:

- Ianuarie (start bugete): Prioritizează echipamentele cu valoare mare, considerate investiții.

- Octombrie (final de sezon în construcții): Prioritizează lichidarea stocurilor de materiale sezoniere sau perisabile.

Exemplu: "Este sezonul agricol? Aplică un boost (promovare) la piesele de schimb pentru combine agricole"

Reguli de compatibilitate tehnică (specifice per domeniu):

În B2B tehnic, compatibilitatea este binară: merge sau nu. Se folosesc sisteme expert, definite pe detaliile din fișa de specificații.

Exemplu: Verifică atributul Socket al procesorului din coș. Elimină (en. filter out) din lista de recomandări orice placă de bază care nu se potrivește conform atributului.

Din punct de vedere tehnic, guardrails sunt clasificate în hard (filtre și eliminări), soft (promovări și retrogradări în ordinea listei) și de proces (necesare pentru control și audit. Ex: "cere permisiune pentru discount prea mare" / "Notează aplicarea regulii în log").

GIGO

Contractul de date

Principiul "Garbage In, Garbage Out" spune că fără date proaspete corecte, și recomandările AI vor da rezultate greșite. Orice schimbare în sursa fundamentală de adevăr a companiei (ex: actualizare ERP, schimbare TVA sau modificarea unei categorii cruciale) poate distruge integrările.

Soluția este definirea unui Contract de date între echipa care gestionează sursa de adevăr (ERP, WMS, CRM, e-commerce) și echipa care gestionează integrarea AI.

1. Pregătirea datelor: de la haos la claritate

Imaginați-vă că explicați unei persoane pentru prima dată ce aveți în companie, fără prescurtări, fără scurtăturile procedurale apărute în timp, și fără a vă grăbi. Când ați terminat explicația, sunteți pregătiți pentru AI.

Aceste proceduri cresc la maxim claritatea operațională a companiei și reduc la minim datoria tehnică acumulată în trecut.

| Pas | Ce înseamnă? |

|---|---|

Deduplicareaunificarea datelor similare |

Există încă ERP-uri în care același produs fizic există sub mai multe coduri (ex: codul vechi al furnizorului X și codul nou al furnizorului Y). Dacă istoricul de vânzări este spart între două coduri, AI va recomanda slab două produse, în loc să recomande unul mai puternic. Soluția: Toate variantele sunt deduplicate către un master SKU unic (ID canonic) și modelului i se trimit datele reunite, ca și cum ar fi un singur produs. |

Normalizareacurățarea atributelor |

Uniformizarea unităților de măsură și a valorilor. Se realizează prin înlocuirea valorilor care sunt identice semantic cu o cheie comună într-un dicționar. Soluție: "100 mm", "10 cm", "0.1 m" și "100 milimetri" trebuie normalizate: transformate într-o singură valoare standard (ex: length_mm: 100). Culorile "verde", "verd", "green" și "vert" devin Color_id: 23. |

Denormalizareaviteză pentru căutare semantică |

Bazele de date din spatele ERP-urilor, dacă sunt normalizate corect, vor conține tabele separate legate prin ID-uri. Culoarea verde a devenit Color_id: 23. Dar AI are nevoie de citire rapidă și înțelegere semantică, el înțelege de fapt "verde", ca un vorbitor de limba română. Soluție: Pentru citire de AI, datele sunt denormalizate. Fiecare obiect devine plat cu multe atribute text: numele categoriei, numele brandului și fiecare specificație. Scopul este să fii cât mai aproape de limba română (uneori chiar în mai multe variante). |

Vezi metodologia OPTI Software în Cap. 5.3.2

2. Schema de date: structura

Pentru ca integrarea să se "înțeleagă" cu sursa datelor, se definesc trei nivele. Entitățile care se vor sincroniza, cum trebuie să arate câmpurile lor de date și care sunt consecințele pentru integrare când contractul este încălcat.

| Entitate | Verificare (exemple) | Consecințe (exemple) |

|---|---|---|

|

Produs |

Price este tip float (100.12), nu text ("100,12 EUR"), nu gol. |

Ultimele date sincronizate rămân nemodificate. |

|

Produs |

Product_id nu este gol și este unic. |

Alertă pe email/Slack, în special când lipsesc datele. |

|

Client |

CUI poate fi precedat de un cod ISO 3166-1 alpha-2 (ex: RO) |

Se apelează VIES pentru a confirma validitatea codului |

|

... |

... |

... |

3. Semantica datelor: înțelesul

Dezvoltatorii aplicației de AI trebuie să înțeleagă ce înseamnă datele din sistemele sursă, pentru a menține identic comportamentul întregului sistem, în special față de clientul final.

Atenție la orice ține de următoarele:

| Atenție la | Verificare (exemple) | Consecințe (exemple) |

|---|---|---|

|

Catalog |

Acest câmp lung "descriere veche" e calitativ, la ce folosește? |

Folosiți doar datele validate. |

|

Prețuri |

Cu TVA sau fără TVA? |

Afișați doar prețuri sigure. |

|

Prețuri |

Facturile cu -1 la cantitate sunt retururi sau discounturi? |

Nu tratați returul ca semnal pentru model. |

|

Stocuri |

Fizic, disponibil (-rezervat) sau liber la raft (din WMS)? |

Ignorați produsele fără stoc. |

|

Fluxuri |

Există asocieri: prețuri per client per departament? |

Modificați logica interogării AI în funcție de asocieri. |

|

... |

... |

... |

Înțelesul fiecărui câmp contează pentru varianta Build, pentru a nu antrena un model pe corelații irelevante. Contează și în varianta Managed, ca la orice integrare SaaS.

Exemplu integrare ERP-CRM SaaS

O companie nu putea completa mai mult de o adresă email per client B2B în ERP, așa în practică folosea câmpul "descriere" pentru a ține adresele reprezentanților clientului. La integrarea cu un CRM (HubSpot / Pipedrive / Zoho) unde reprezentanții erau entități distincte, scriptul a trebuit să mapeze câmpul text "descriere" din ERP în multiple entități din CRM și să mențină sincronizarea.

4. SLA de date: latență și race conditions

Se definesc condiții de forma "Modificările de stoc trebuie să ajungă în AI în maxim 5 minute", "Când ERP nu funcționează, se folosesc ultimele date, dar nu se mai dau discounturi" pentru a asigura consistența și previzibilitatea sistemului.

Race conditions

Sincronizarea modificărilor între sisteme în timp util. Dacă un client cumpără ultimul produs la 14:00, iar sistemul îl recomandă la 14:05 altui client, contractul de date a fost încălcat.

Soluție: Verificări imediate (en. just-in-time) în middleware sau aplicație:

- AI selectează produsul pe baza datelor (ex: vechi de 10-15 minute).

- Sistemul cere o confirmare în ERP sau într-un strat de cache rapid (recomandat).

- Dacă nu se primește răspuns, intră în funcțiune mecanismul de fallback.

Studiu de caz: Construcția unei platforme de microplăți pentru Playwing

5. Checklist: Date necesare pentru o implementare AI în vânzări

| Tip date | Bifați | |

|---|---|---|

|

✔ |

Catalog |

SKU, categorii, atribute și reguli de compatibilitate, brand, status, preț listă. |

|

✔ |

Inventar |

Stoc și gestiuni, rezervări de stoc, rotație, loturi și vechime. |

|

✔ |

Prețuri B2B |

Liste de prețuri, discounturi, termene de valabilitate. |

|

✔ |

Clienți |

Segmente, restricții, beneficii. |

|

✔ |

Vânzare și evenimente |

Comandă minimă / produs, Canale de vânzare, oferte, comenzi, comenzi furnizor, liniile la fiecare, feedbackuri, clickuri și adăugări în coș (doar e-commerce). |

|

✔ |

Surse de adevăr |

ERP, CRM, e-commerce, fișiere, procedurile companiei. |

Contractul de date stabilește schema, semantica, pregătirea datelor și SLA pentru datele companiei care sunt afectate de implementarea AI.

Pe scurt:

- Sistemul de recomandări nu este un singur algoritm, ci un ansamblu de modele și reguli de business, pentru fiecare moment de pe parcursul vânzării.

- Programarea sau configurarea atentă și procesele de testare sunt esențiale.

- Implementarea începe cu înțelegerea strategiei comerciale și a datelor companiei.

Vezi exemple de cod și configurare pentru guardrails și ingestie de date în Cap. 4, pentru Build și Managed.

Reglaje de finețe

Iată două provocări tehnice de finețe, întâlnite în implementările reale de AI pentru vânzări.

Alegerea modelului potrivit pentru funcția de business

Cele mai populare modele funcționează diferit și trebuie adaptate la momentul din secvența de cumpărare (en. customer journey):

| Model | Recomandare | |

|---|---|---|

|

1 |

Cumpărate împreună (en. Frequently Bought Together) |

Ideal în e-commerce pentru pagina de coș. Se bazează pe analiza coșurilor istorice. Ajută la descoperirea produselor complementare, pentru cross-sell. |

|

2 |

Similare (en. Others You May Like / Similar Items) |

Ideal în e-commerce pentru pagina de produs (bazat pe similaritate cu produsul curent). Ia în considerare clientul (în varianta Others You May Like), estimând ce alt produs poate fi cumpărat. Ajută la descoperirea alternativelor, pentru upsell. |

|

3 |

Recomandat pentru tine (en. Recommended for You) |

Ideal în e-commerce pentru homepage și listări (ex: newsletter, categorie). Se bazează pe istoricul clientului. |

|

4 |

Cumpără din nou (en. Buy it Again) |

Indică produsul cel mai probabil de re-stocat după cumpărături anterioare. Pentru predicția necesității de restocare în B2B, este necesară prognoza temporală (en. time-series modeling, model custom). |

În abordarea Build (custom), aceste modele se definesc și antrenează separat, cu refolosirea unor componente comune.

În abordarea Managed (Cloud Native), se pornește prin configurarea modelelor predefinite de Google pentru cazurile populare de mai sus. Obții livrare mai rapidă și posibilitatea de a alege obiectivul de business maximizat, fără a putea să modifici modelul de bază.

Bundling și pachete dinamice

În B2B gruparea produselor crește valoarea comenzii (AOV). Și mai mult, bundling-ul reduce costurile logistice.

- Dacă clientul cumpără tot sistemul într-o singură comandă, distribuitorul trimite un singur palet, o singură factură și face un singur transport.

- În loc de 3 comenzi a câte 300 EUR cu 3 transporturi, un pachet de 900 EUR într-o singură livrare, cu un discount dar cu o marjă totală mai bună.

Pentru a implementa pachete, avem nevoie de inginerie de date sau de o abordare hibridă.

1. Discount inteligent la cumpărare (standard)

De ce? Se oferă un discount inteligent la cumpărarea împreună (în coș sau offline). În distribuție, valoarea stă în soluții complete, nu produse disparate.

Cum?

- Sistemul de recomandări sugerează multiple produse cumpărate împreună și asemănătoare cu produsul principal.

- În varianta Managed se pot folosi Collections: în aplicație preclasifici pachetele acceptate și trimiți ID-urile pachetelor la fiecare produs conținut. Serviciul le va agrega relevanțele, dar fără garanție 100%.

- Regulile filtrează apoi combinațiile care formează un sistem funcțional compatibil (ex: Centrală + termostat + kit Evacuare) pe baza fișelor tehnice.

- Se adaugă un discount și creează livrabilul Pachete dinamice din Cap. 3, crescând AOV fără efort uman.

2. Pachete direct în catalog

De ce? Se creează pachete cu ID propriu pentru creșterea rotației de stoc și profitabilității.

Cum?

- Sistemul de recomandări identifică produsele cu atracție mare. Se identifică și produsele cu stoc vechi (en. slow-moving), chiar dintre cele recomandate de AI.

- Se creează în logica aplicației un pachet virtual cu stocul calculat ca cel mai mic raport stoc / bucăți folosite în pachet și cu verificarea marjei minime totale per pachet.

- Se definește un flux de automatizare care le introduce în catalog, căutare, pagină de produs și afiliați (ex: marketplace), sporind numărul de produse și diversitatea pentru client.

- Pachetele pot fi trimise ca produse normale (primare) către AI.

Prima implementare implică modificarea coșului de cumpărături și a modulului de comenzi. A doua implementare implică integrarea în adâncime cu fluxurile comerciale automatizate.

Pe lângă aceste provocări, există și altele legate de scalabilitate, latență, securitate și monitorizare, în funcție de complexitatea fluxurilor companiei. Dar tehnologia AI pentru vânzări B2B există, cum am arătat în acest capitol.

Esențialul:

În 2026 cel mai bun agent de vânzări nu este AI, ci omul asistat de AI. Am analizat motorul tehnologic pentru vânzări AI: căutare vectorială, re-ranking, guardrails și contract de date. Companiile care își curăță datele și își definesc regulile comerciale vor fi cele care vor beneficia de AI în vânzări, și în varianta Build (custom), și în varianta Managed (Cloud Native), la alegerea companiei.

Ce aplicații concrete pot fi folosite de agenții de vânzări?

Nu ești sigur ce arhitectură ți se potrivește? OPTI Software oferă un audit tehnic gratuit

Continuă în ghid

Întrebări rapide

Ce este arhitectura în doi pași (Retrieval și Ranking)?

Este o abordare în care sistemul identifică mai întâi un set mic de produse candidate (Generare/Retrieval), apoi le ordonează fin folosind scoruri AI și reguli de business (Ranking). Aceasta este baza majorității sistemelor moderne de recomandări AI scalabile.

De ce two-towers este folosit frecvent în Retrieval?

Pentru că separă reprezentarea clientului de cea a produsului, permițând căutări rapide la scară mare. Este eficient pentru selecția inițială, chiar dacă ranking-ul final poate folosi modele mai complexe.

Ce rol joacă guardrails în arhitectură?

Guardrails sunt regulile care transformă un scor AI într-o decizie comercială validă: marjă minimă, stoc, contract, permisiuni. Fără ele, recomandările AI pot deveni periculoase pentru imagine și obligațiile companiei.

Ce înseamnă contractul de date?

Un acord explicit asupra semnificației, formatului și disponibilității fiecărui câmp de date folosit. Este fundația care face sistemul audibil, explicabil și sustenabil.

Când are sens o arhitectură hibridă Build + Managed?

Alege hibrid (date locale + cloud pentru AI) când vrei să beneficiezi de modele pre-antrenate pentru viteză, dar păstrezi controlul asupra logicii comerciale, datelor sensibile și regulilor specifice companiei. Alege construcție hibridă AI (modele pre-antrenate + modele custom) când dorești facilități care nu sunt incluse în modelele pre-antrenate disponibile.

Care este concluzia (TLDR)?

Capitolul formulează o schemă tehnică logică peste o problemă complicată: cum folosești AI pentru a selecta candidați relevanți, a îi ordona și cum aplici reguli ca să nu vinzi greșit (stoc, preț contractual, marjă, permisiuni).

Care sunt tehnologiile și metodologiile implicate?

Tehnologii: Vertex AI Search, Vertex AI Search for commerce, Vertex AI Recommendations, Retail API, BigQuery, BigQuery ML, Feature Store, Cloud Storage, Pub/Sub, Dataflow, Cloud Run, Cloud IAM, Cloud KMS

Metodologii: two-stage recsys, learning-to-rank, candidate generation, post-processing, hard rules vs soft boosts, just-in-time validation, data quality checks, offline evaluation (Recall/NDCG), segmentation (account-level), privacy by design

Cere formatul PDF complet

Manualul este disponibil și în variantă PDF completă. OPTI Software trimite o dată pe lună noutăți Tech & Biz exclusive.