Inteligența artificială bazată pe LLM (ex: Gemini în Google Cloud) a explodat, dar companiile din economia reală de producție, distribuție, B2B, au realizat o limitare fundamentală: rețelele neuronale pure sunt probabilistice. Ele „ghicesc" răspunsuri, pot genera halucinații, pot recomanda produse incompatibile tehnic sau pot ignora marjele comerciale.

Pentru a rezolva această problemă, multe companii din S.U.A nu au abandonat inteligența artificială, ci au elaborat un concept fundamental: Arhitectura hibridă AI.

În recentul Ghid #1: Recomandări inteligente, upsell și reguli, OPTI Software a detaliat cum această abordare este singura cale viabilă pentru implementarea AI în comerțul B2B, inclusiv din România. În acest articol, explorăm teoria din spatele arhitecturii hibride și modul în care o adaptăm pentru midmarket local, de la protecția datelor, la soluții on-premise. Plus: viitorul generării configurative de bill of materials (BOM).

1. De la „Black Box" la Neuro-Symbolic AI

Conceptul de inteligență artificială neurosimbolică (en. Neuro-Symbolic AI) nu este deloc nou. Rădăcinile sale teoretice datează din anii '90, când cercetători precum Jude Shavlik, Henry Kautz și Artur d'Avila Garcez au explorat limitele sistemelor bazate doar pe statistici și probabilități.

Teoria neuro-simbolică din Silicon Valley unifică două școli de gândire diferite istoric:

- AI bazat pe simboluri și reguli (Good Old-Fashioned AI - GOFAI): Se folosește și logică strictă, reguli de tip „IF-THEN" și arbori de decizie. Este 100% explicabil și precis, dar aproape imposibil de scalat când datele sunt nestructurate sau în volum imens.

- AI bazat pe conexiuni (Deep Learning / Rețele neuronale): Excelează la recunoașterea tiparelor în volume uriașe de date, învățând din exemple precedente. Are limitare că este o cutie neagră (en. Black box), nu are explicabilitate 100% și nici capacitatea de a respecta reguli stricte, de unde apar halucinațiile.

Arhitectura hibridă ideală le îmbină pe amândouă. Teoria este că vom folosi rețelele neuronale pentru asocieri și identificarea tiparelor (ex: înțelegerea intenției unui client e-commerce doar din istoricul bogat de navigare), dar verificăm rezultatele printr-un motor simbolic (reguli) care validează decizia finală.

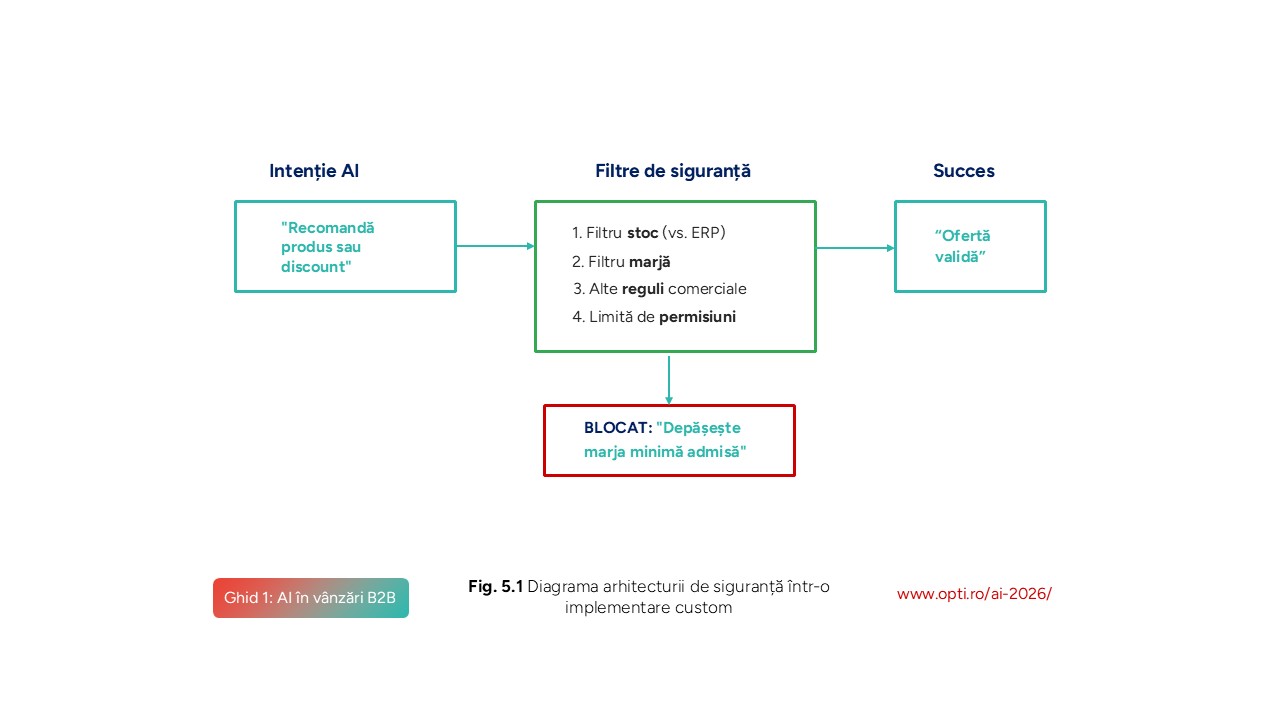

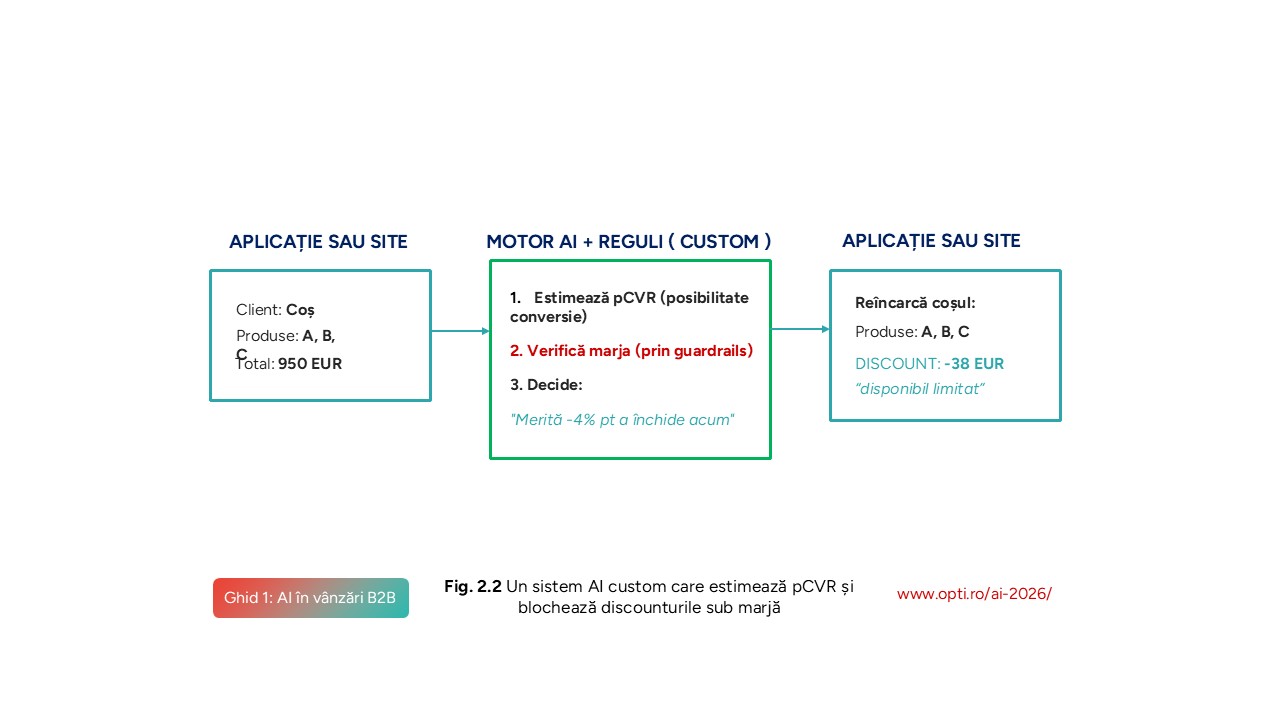

Legendă: Diagrama arhitecturii de siguranță într-o implementare custom Link în ghid

Arhitectura hibridă promovată de OPTI Software se bazează pe verificarea rezultatelor AI prin reguli deterministice ale companiei. Scopul este ca inteligența artificială și agenții AI să fie explicabili, măsurabili și siguri pentru mediul de business.

2. Problema datelor: Cum protejăm secretele comerciale cu un middleware local (on-premise)

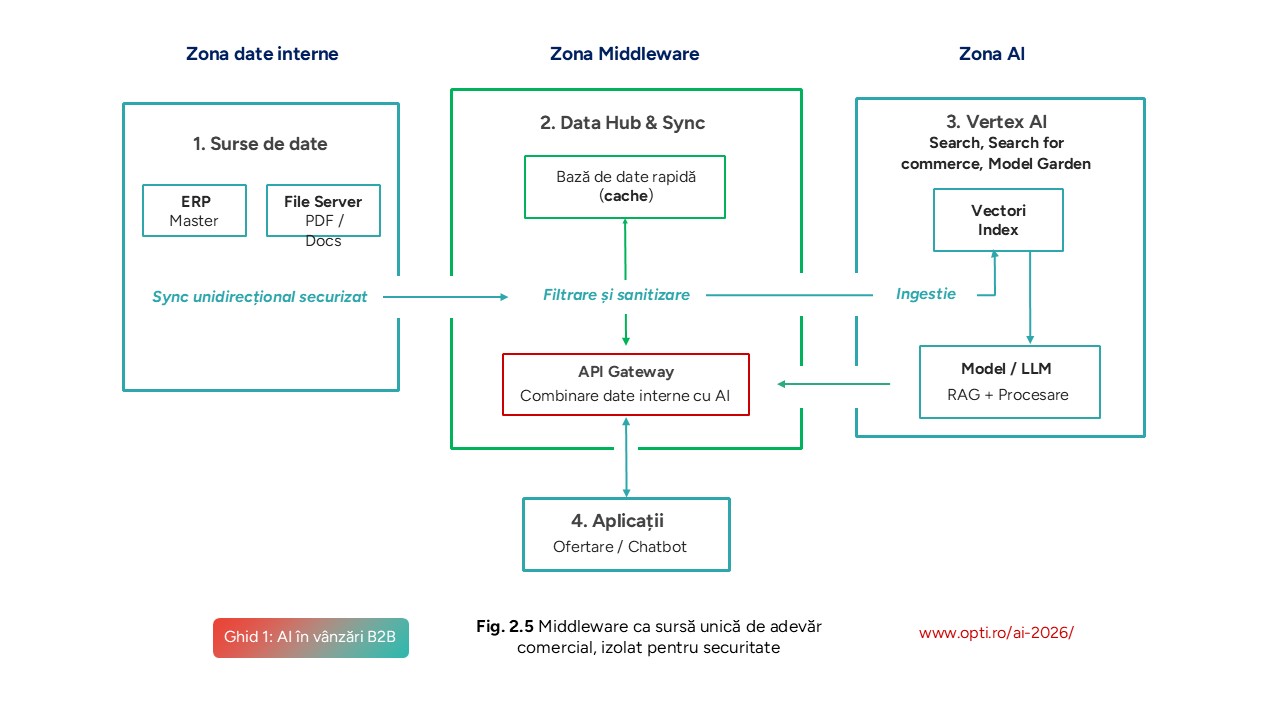

Companiile B2B vor să nu expună datelor confidențiale (liste de prețuri negociate, stocuri strategice, datele clienților) către sisteme externe și ca AI să nu învețe din datele lor. Există o abordare de tip „privacy-first", în care o componentă critică rulează on-premise sau într-un mediu cloud privat, iată diagrama:

Legendă: Middleware ca sursă unică de adevăr comercial, izolat pentru securitate. Link în ghid

Esența abordării privacy-first:

- Sistemele centrale de gestiune (ERP, WMS) nu se modifică și nu comunică direct cu inteligența artificială

- Se construiește un middleware centralizat. El este ca un scut izolat.

- Middleware-ul prelucrează datele și aplică pseudo-anonimizarea (ex: hashing pe ID-urile clienților) înainte ca orice informație să plece spre cloud.

- Middleware-ul păstrează regulile de preț și stocul real on-premise. Modelul AI din cloud returnează doar ID-urile produselor recomandate (faza de Retrieval și Scoring), iar middleware-ul local le îmbogățește imediat cu prețurile specifice clientului logat și verifică disponibilitatea (stocul).

Datele sensibile nu ajung în modelul AI din cloud, asigurând conformitatea cu normele NIS2 și GDPR, păstrând în același timp controlul total pentru companie.

3. Viteza inovației: AI în cloud sau rularea unui LLM local?

Multe echipe de IT analizează și varianta folosirii unor modele open-source (ex: Llama, Mistral) cu rularea unui LLM local pe serverele proprii, alocând resurse de server pentru acest lucru. Deși pare a oferi control total, această abordare are costuri și limitări de scalabilitate pe care trebuie să le luați în considerare. Iată un tabel:

Legendă: Tabel comparativ Build / Custom vs Managed / Cloud Native

De ce recomandăm serviciile cloud ca Vertex AI de la Google, cu protecția datelor companiei?

- Evoluția tehnologiei: Algoritmii din cloud evoluează cu o viteză imposibil de egalat de o echipă in-house. Modelele pre-antrenate beneficiază de actualizări continue ale arhitecturii de bază. Dacă o companie implementează azi un LLM local, în 6 luni acesta devine uzat (legacy) și grijă permanentă cu o echipă alocată.

- Costuri ascunse și latență: Rularea locală a modelelor predictive sau generative necesită infrastructură hardware (clustere de GPU-uri, Kubernetes). În plus, sistemele de recomandări scalabile au nevoie de latențe stricte (chiar milisecunde), lucru greu de obținut cu un LLM local neoptimizat.

- Eficiență bugetară: Cu API din cloud, compania plătește strict pentru utilizare (pay-as-you-go) și transferă complexitatea mentenanței către Google (sau alt cloud), concentrându-se pe calitatea propriilor date, proecția lor (ex: privacy first) și definirea regulilor de business care garantează rezultatul.

4. Viitorul apropiat: Composite AI pentru oferte complexe (BOM)

Pe măsură ce ne apropiem de anul 2027 abordat pe larg în ghid, granița dintre căutare, recomandare și ofertare se estompează.

Soluția supremă pentru distribuitorii de echipamente tehnice (HVAC, electrice, materiale de construcții) este așa numit-ul AI compus (en. Composite AI).

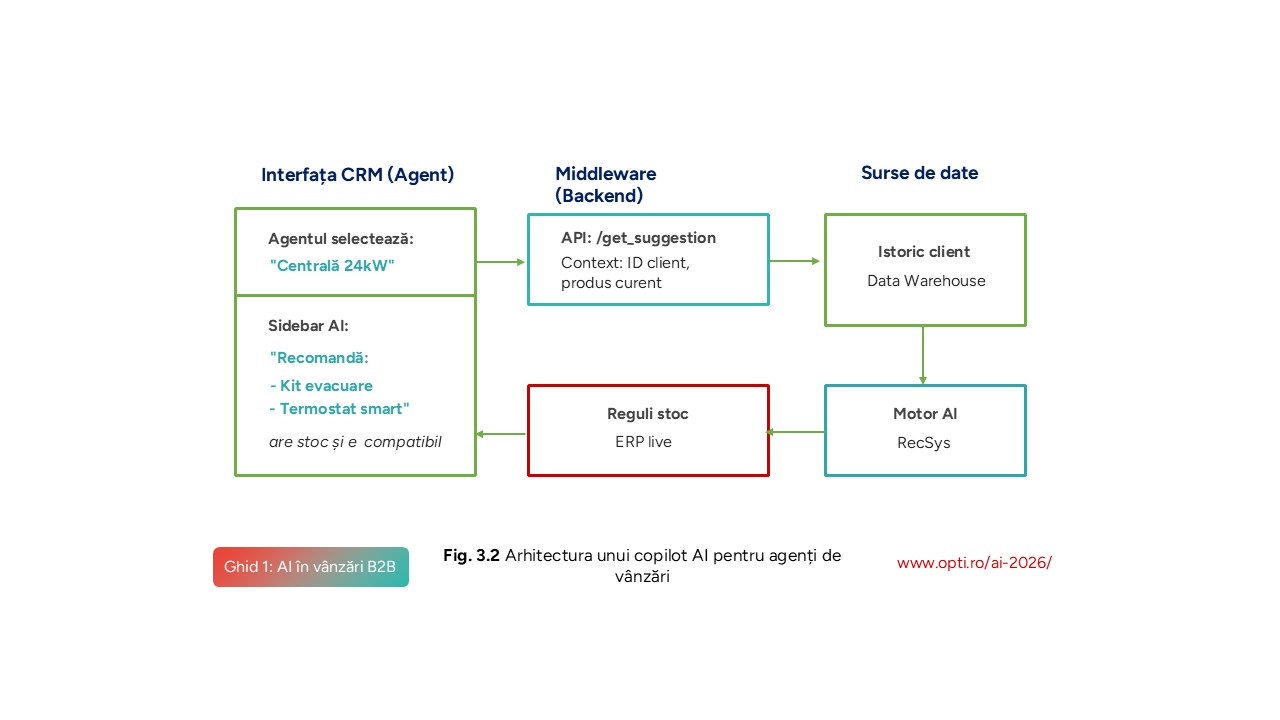

Spre deosebire de un AI simplu care recomandă un singur produs, un agent bazat pe Composite AI poate genera o soluție completă – un Bill of Materials (BOM), necesar în orice proces complex de ofertare. Baza este livrabilul 1 din ghidul OPTI, copilotul de vânzări:

Legendă: Arhitectura unui copilot AI pentru agenți de vânzări. Link în ghid

Un exemplu cu BOM:

- Un designer interior încarcă un plan PDF al unei bucătării

- Cere toate piesele de mobilier necesare până la cuie și mânere.

- Agentul AI compus descompune cererea, folosește GraphRAG (înțelegerea relațiilor spațiale și logice dintre piese, nu doar căutare de text) pentru a găsi mii de componente compatibile pe stoc

- Agentul AI validează proiectul printr-un motor de constrângeri (ex: se potrivesc ușile cu balamalele?)

Astăzi un specialist de ofertare lucrează 48 de ore pentru a extrage un BOM manual, dar arhitectura hibridă avansată (Composite AI) va schița o ofertă validă în doar câteva minute, oferind distribuitorului un avantaj competitiv uriaș.

5. Exemple din experiența OPTI

Pentru distribuitorii și producătorii care gestionează cataloage de zeci sau sute de mii de produse, arhitectura hibridă OPTI Software se traduce printr-un pipeline clar de execuție.

Legendă: Un sistem AI custom care estimează pCVR și blochează discounturile sub marjă Vezi în ghid

Generarea candidaților și Scoring (componenta neuronală)

- Algoritmii de Deep Learning din soluții precum Vertex AI Search for commerce de la Google (varianta Cloud Native) analizează comportamentul utilizatorilor și cataloagele de produse.

- Se înțeleg asocierile semantice („țeava de cupru" este corelată cu „fitingurile de cupru", chiar dacă cuvintele diferă) și generează un scor de probabilitate a conversiei (pCVR).

Guardrails: reguli de Business (componenta simbolică):

- Sistemul primește recomandările AI, dar înainte de a le afișa clientului, aplică contractul de date și regulile de siguranță.

- Dacă AI sugerează un produs care a ieșit din stoc, care are o marjă comercială negativă sau care este incompatibil tehnic cu produsul principal (ex: procesoare AMD cu plăci de bază Intel), regulile deterministice (simbolice) vor bloca sau retrograda acea recomandare.

Curățenia datelor (en. Data cleaning):

- Niciun sistem AI nu poate funcționa fără un strat de date impecabil. Dedublarea, normalizarea atributelor și standardizarea unităților de măsură din ERP sunt pașii premergători obligatorii.

- Algoritmii neuronali nu pot „ghici" că „Rob. buc. Cr." înseamnă „Robinet bucătărie cromat" fără un dicționar simbolic și un proces de curățare.

Ești gata să adopți AI pentru compania ta?

Descarcă gratuit Ghidul #1 OPTI: Recomandări inteligente, upsell și reguli (172 pagini) și află cum poți implementa soluțiile tehnologice din Silicon Valley, adaptate pentru realitățile pieței B2B din România.

Descarcă gratuit Ghidul #1 OPTI: Recomandări inteligente, upsell și reguli (172 pagini)

![[UPDATE] Premiile startup-urilor românești se decernează pe 12 martie. Mr.Benny a câștigat locul 3 la categoria cybersecurity la Romania Startup Awards 2026 [UPDATE] Premiile startup-urilor românești se decernează pe 12 martie. Mr.Benny a câștigat locul 3 la categoria cybersecurity la Romania Startup Awards 2026](/images/new-post/small_long-romania-startup-awards-2026-mrbenny.jpg)